[논문리뷰] Hyperagents

링크: 논문 PDF로 바로 열기

당신은 해당 분야의 전문 연구원입니다. 주어진 논문을 분석하여 핵심 내용을 명확하고 전문적으로 요약해주세요.

Constraints (Critical)

- Technical Terminology in English : 논문에 등장하는 핵심 기술 용어, 지표(Metric), 약어, 포맷 명칭 등은 억지로 한국어로 번역하지 말고 영어 원문 그대로 사용하세요. (예: Granularity, Outlier, Throughput, Latency, End-to-End 등)

- Natural Korean Phrasing : 문장의 전체적인 구조는 자연스러운 한국어로 작성하되, 명사나 핵심 동사는 영어를 섞어 사용하는 전문적인 문체를 유지하세요.

- Mandatory Metadata : 요약 본문 시작 전에 저자 정보와 키워드를 반드시 먼저 작성하세요.

출력 형식

출력은 반드시 두 부분으로 구성됩니다:

- Part 1 : 요약 본문 (마크다운)

- Part 2 : 중요 Figure 정보 (JSON)

Part 1: 요약 본문

메타데이터

저자: Jenny Zhang, Bingchen Zhao, et al.

본문 섹션

1. Key Terms & Definitions (핵심 용어 및 정의)

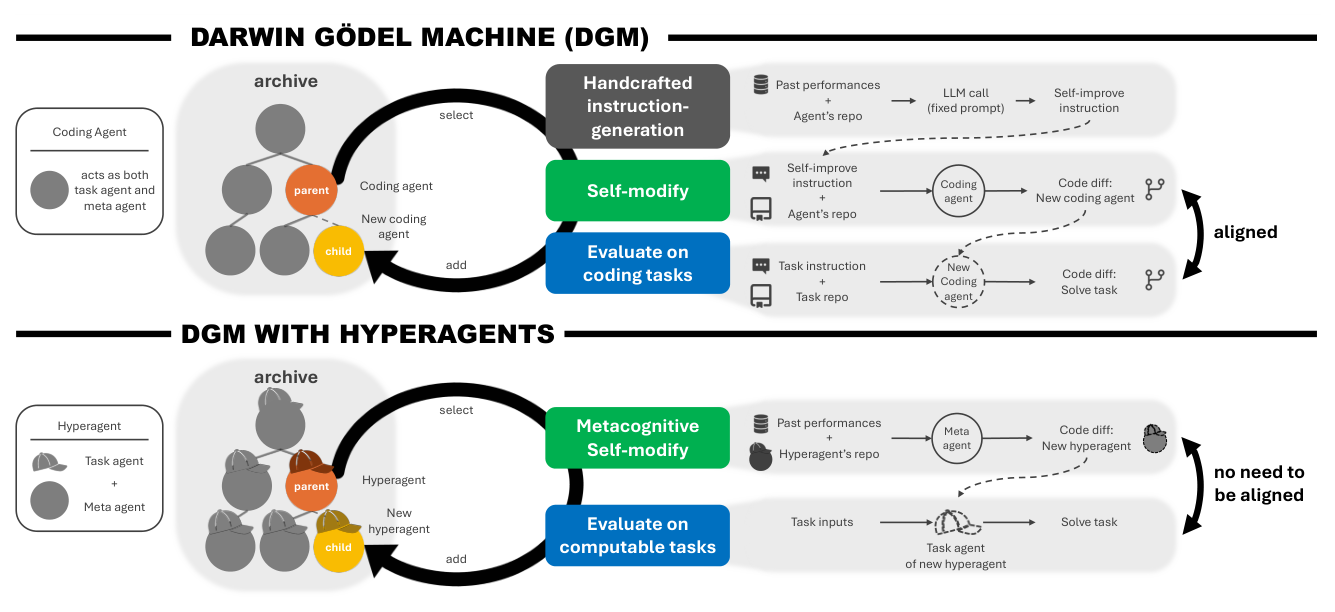

- Hyperagent : Task agent와 Meta agent를 단일 편집 가능 프로그램으로 통합한 Self-referential agent. Task 해결 방식과 미래 개선 사항 생성 방식 모두를 개선할 수 있음.

- Task Agent : 주어진 Task를 해결하도록 인스턴스화된 Agent.

- Meta Agent : 기존 Agent를 수정하고 새로운 Agent를 생성하는 역할을 하는 Agent.

- Metacognitive Self-modification : Hyperagent의 Self-improvement 메커니즘 자체가 수정 가능하여, Task 해결 행동뿐만 아니라 미래 개선 사항을 생성하는 메커니즘까지 개선하는 과정.

- Darwin Gödel Machine (DGM) : Open-ended Self-improvement를 코딩 Task에서 시연한 시스템. 성공적인 변형체를 Archive에 저장하여 미래 개선을 위한 Stepping stone으로 활용함.

2. Motivation & Problem Statement (연구 배경 및 문제 정의)

기존 Self-improving AI 시스템은 대부분 고정된 Meta agent에 의존하여 Self-improvement 메커니즘의 개선에 근본적인 한계가 있었습니다. 이는 Meta agent의 설계에 의해 Base system의 개선 범위가 제한되는 문제를 야기하며, Meta-meta 시스템을 추가하는 방식으로는 이 문제가 해결되지 않고 무한 회귀로 이어집니다. 특히, 기존 DGM은 코딩 Task에 특화된 고정된 Instruction-generation 메커니즘을 사용하므로, Evaluation Task와 Self-modification Task 간의 Alignment가 코딩 도메인 외에서는 유지되지 않아 다른 도메인으로의 일반화가 어렵습니다. 이러한 한계점을 극복하고 어떠한 Computable Task에서도 시스템이 스스로를 개선할 수 있도록, Self-modification 메커니즘 자체를 수정할 수 있는 Self-referential 시스템이 필요합니다.

3. Method & Key Results (제안 방법론 및 핵심 결과)

본 연구는 Task 실행과 Agent 생성을 단일 편집 가능 프로그램으로 통합하는 Hyperagent 를 제안하며, 이를 Darwin Gödel Machine 에 확장하여 DGM-Hyperagents (DGM-H) 를 구축합니다

DGM-H는 Meta-level Modification 메커니즘 자체를 편집 가능하게 함으로써, Agent가 Task 해결 방식뿐만 아니라 Self-improvement 방식까지 개선할 수 있는 Metacognitive self-modification을 가능하게 합니다.

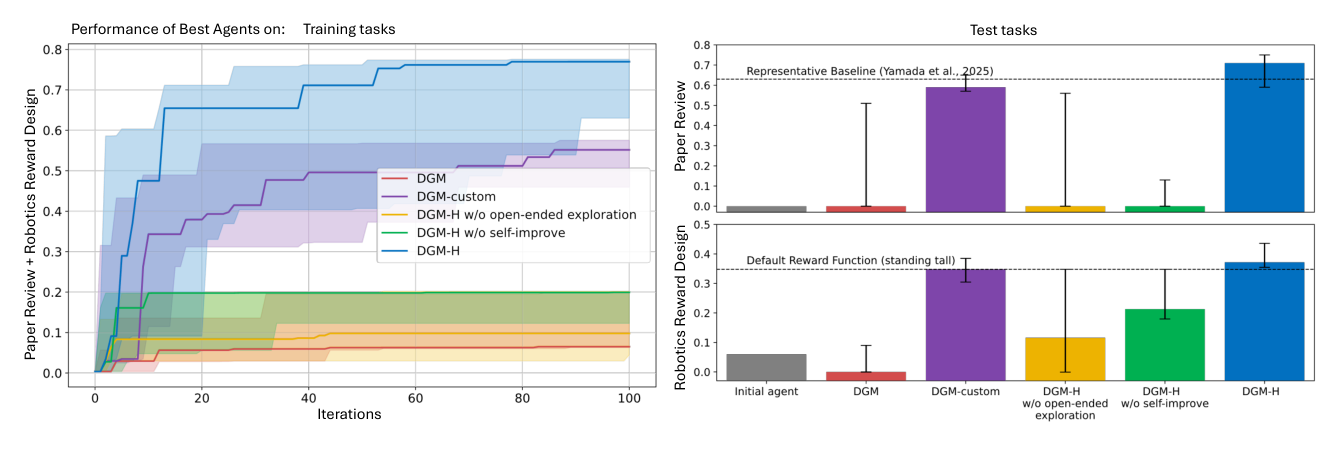

다양한 도메인(코딩, Paper review, Robotics reward design, Olympiad-level math grading)에 걸친 실험에서 DGM-H는 Baseline 시스템들을 능가하는 상당한 성능 향상을 보였습니다. 예를 들어, Polyglot 코딩 벤치마크에서 초기 Agent의 Training 성능은 0.140 에서 0.340 로, 전체 벤치마크 Test 성능은 0.084 에서 0.267 로 향상되었습니다. Paper review와 Robotics reward design 도메인에서도 Baseline을 뛰어넘는 결과를 달성했으며, Self-improvement나 Open-ended exploration이 없는 Ablation 버전들은 거의 발전하지 못했습니다

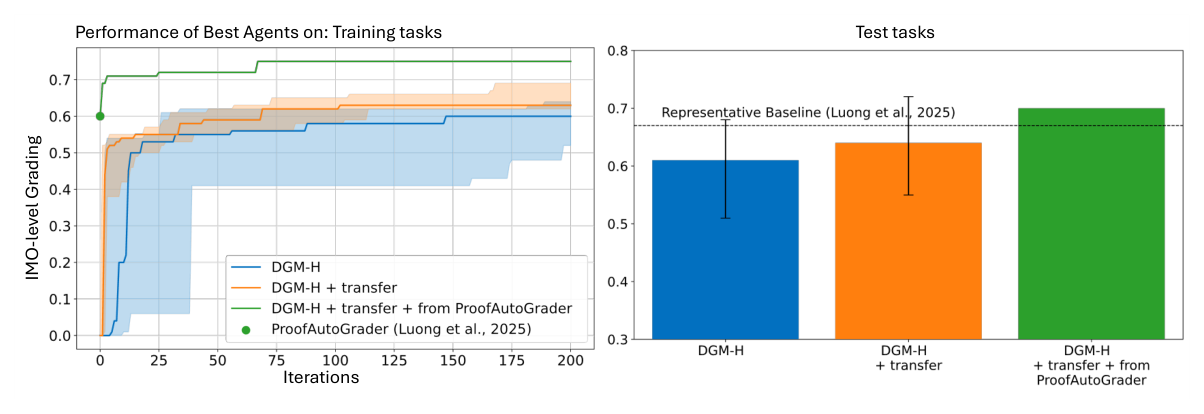

또한, DGM-H는 Self-improvement 능력을 자체적으로 개선하는 Transferable 메커니즘(예: Persistent memory, Performance tracking)을 학습했습니다. 이전 실행에서 최적화된 Hyperagent는 새로운 도메인인 Olympiad-level math grading에서 Task Agent를 개선하는 데 Transferable한 능력을 보이며, Imp@50 Metric에서 초기 Agent의 0.0 와 비교하여 0.630 의 큰 개선을 달성했습니다 [Figure 3]. 이러한 Self-improvement는 다양한 도메인과 실행에 걸쳐 축적될 수 있음이 입증되었습니다. IMO-GradingBench에서 ProofAutoGrader와 이전 DGM-H 실행에서 학습된 Transfer meta agent를 결합했을 때, Test-set score 0.700 를 달성하여 ProofAutoGrader의 0.670 를 능가했습니다

이는 DGM-H가 기존의 강력한 솔루션을 기반으로 성능을 더욱 향상시킬 수 있음을 보여줍니다.

4. Conclusion & Impact (결론 및 시사점)

DGM-Hyperagents는 Open-ended Self-improvement를 다양한 Computable Task에 적용할 수 있는 실용적인 프레임워크를 제공합니다. 이 시스템은 단순히 더 나은 솔루션을 찾는 것을 넘어, 스스로 개선하는 능력을 지속적으로 향상시킬 수 있습니다. Metacognitive self-modification과 Open-ended exploration을 통해, DGM-H는 Task Performance와 Self-improvement 능력 모두에서 상당한 일반화 가능한 이점을 가져왔으며, 이는 도메인을 넘어 Transfer되고 실행에 걸쳐 Compound될 수 있음을 보여줍니다. 이러한 Self-accelerating 시스템은 과학적 발견과 기술 발전을 가속화하여 사회에 큰 영향을 미칠 잠재력을 가지고 있습니다. 다만, 잠재적인 위험과 Goodhart's law와 같은 Safety 고려 사항에 대한 지속적인 논의와 연구가 중요합니다.

⚠️ 알림: 이 리뷰는 AI로 작성되었습니다.

관련 포스트

- [논문리뷰] GradMem: Learning to Write Context into Memory with Test-Time Gradient Descent

- [논문리뷰] Estimating Time Series Foundation Model Transferability via In-Context Learning

- [논문리뷰] LLMs4All: A Review on Large Language Models for Research and Applications in Academic Disciplines

- [논문리뷰] AMFT: Aligning LLM Reasoners by Meta-Learning the Optimal Imitation-Exploration Balance

- [논문리뷰] Where Should Diffusion Enter a Language Model? Geometry-Guided Hidden-State Replacement

댓글