[논문리뷰] LoopCTR: Unlocking the Loop Scaling Power for Click-Through Rate Prediction

링크: 논문 PDF로 바로 열기

메타데이터

저자: Jiakai Tang, Runfeng Zhang, Weiqiu Wang, Yifei Liu, Chuan Wang, et al.

1. Key Terms & Definitions (핵심 용어 및 정의)

- Loop Scaling: 모델 레이어를 별도로 쌓는 대신 동일한 레이어를 재귀적으로 반복하여 계산량을 증가시키는 패러다임.

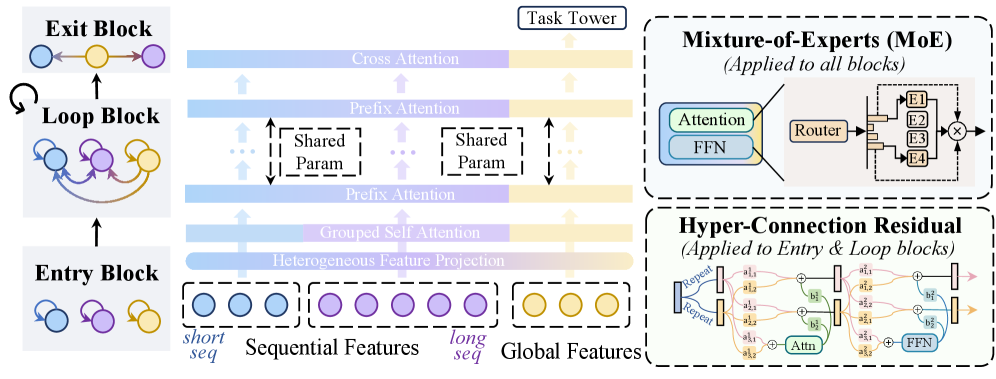

- Sandwich Architecture: Entry Block(특성 인코딩), Loop Block(반복적 추론), Exit Block(예측)으로 분리된 구조.

- Hyper-Connected Residuals (HCR): 고정된 잔차 연결 대신, 입력 의존적 가중치를 통해 여러 병렬 스트림을 적응적으로 융합하는 기법.

- Process Supervision: 모든 루프 깊이에서 모델 예측값을 감독(Supervision)하여, 반복적 추론의 이점을 공유 가중치(Shared parameters)에 인코딩하는 학습 전략.

- Zero-loop Inference: 루프 블록을 거치지 않고 Entry/Exit 블록만 사용하여 추론하는 전략으로, 학습된 반복적 지식을 활용하여 고성능을 유지함.

2. Motivation & Problem Statement (연구 배경 및 문제 정의)

본 논문은 CTR prediction 분야에서 모델 확장(Scaling) 시 발생하는 파라미터 증가와 배포 시의 Latency 제약 사이의 불균형 문제를 해결하고자 한다. 기존의 Depth scaling이나 Width scaling 방식은 모델 성능을 높일 수 있으나, 파라미터 수와 계산량을 동시에 증가시켜 산업계의 저지연(Low-latency) 배포 환경에서 한계를 보인다. 저자들은 기존 Transformer 구조가 고정된 계산 흐름을 가져 표현력의 병목(Expressiveness bottleneck)과 효율성 문제(Efficiency bottleneck)를 겪고 있다고 지적한다. 이를 해결하기 위해 저자들은 파라미터 증가 없이 계산량을 scaling할 수 있는 새로운 루프 기반 패러다임을 제안한다 [Figure 1].

Figure 1 — LoopCTR의 전체 아키텍처

3. Method & Key Results (제안 방법론 및 핵심 결과)

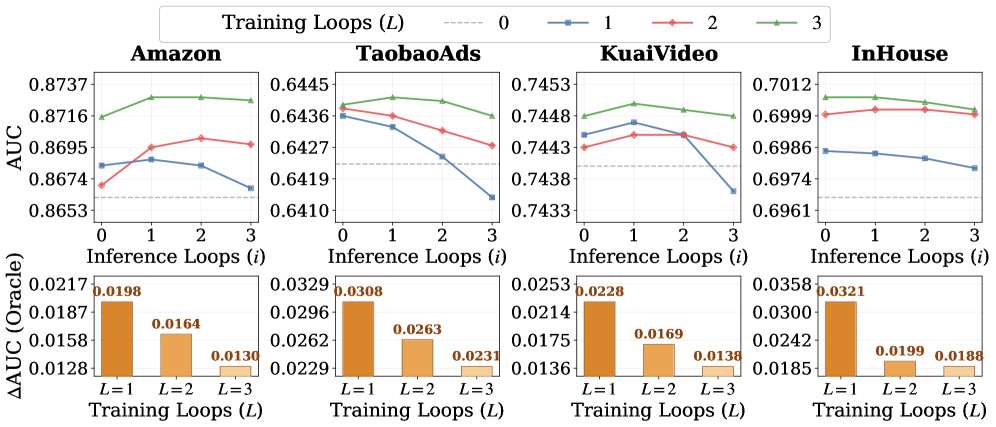

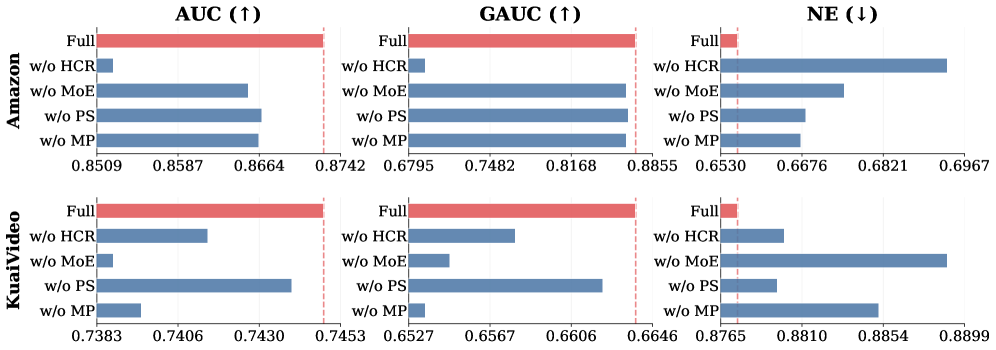

본 논문은 LoopCTR을 제안하며, 이는 재귀적 루프 블록을 통해 파라미터 효율성을 극대화한 Sandwich architecture를 채택한다. Loop Block 내의 표현력을 높이기 위해 MoE-Augmented Transformer를 적용하고, Hyper-Connected Residuals (HCR)를 도입하여 정보 흐름을 동적으로 조정한다 [Figure 1]. 학습 시 Process supervision을 적용함으로써, 여러 번의 루프를 거친 후의 정보가 공유 가중치에 녹아들게 하여, 실제 배포 시에는 루프를 전혀 실행하지 않는 Zero-loop inference만으로도 베이스라인을 뛰어넘는 성능을 달성한다. 실험 결과, LoopCTR(0/3)은 InHouse 데이터셋에서 기존 SOTA 모델 대비 160배 적은 FLOPs와 84배 낮은 Latency로 최고 수준의 AUC를 기록하였다 [Table 2]. 또한 Oracle 분석 결과, 현 제안 모델의 잠재 성능을 완전히 활용하기 위한 추가적인 0.02–0.04 AUC의 향상 가능성이 확인되었다 [Figure 2].

Figure 2 — 루프 스케일링 성능 분석

4. Conclusion & Impact (결론 및 시사점)

본 연구는 CTR prediction에서 파라미터 증가 없이 computation scaling을 달성하는 새로운 loop scaling 패러다임을 확립하였다. LoopCTR은 공유 가중치를 활용하여 과적합을 방지하고 추론 시 효율성을 극대화할 수 있는 강력한 대안을 제시한다. 이 연구가 산업계에 미치는 주요 시사점은, 고성능 모델을 저지연 환경에서도 손쉽게 배포할 수 있는 기술적 토대를 마련했다는 점이다. 향후 연구에서는 루프 깊이를 샘플별로 적응적으로 할당하는 Adaptive inference 전략을 통해 Oracle 성능에 근접하는 추가적인 최적화가 가능할 것으로 기대된다.

Figure 3 — 핵심 구성요소 Ablation 연구

⚠️ 알림: 이 리뷰는 AI로 작성되었습니다.

관련 포스트

- [논문리뷰] Context Unrolling in Omni Models

- [논문리뷰] Contrastive Attribution in the Wild: An Interpretability Analysis of LLM Failures on Realistic Benchmarks

- [논문리뷰] Hierarchical Codec Diffusion for Video-to-Speech Generation

- [논문리뷰] Can Natural Image Autoencoders Compactly Tokenize fMRI Volumes for Long-Range Dynamics Modeling?

- [논문리뷰] AvatarPointillist: AutoRegressive 4D Gaussian Avatarization

Review 의 다른글

- 이전글 [논문리뷰] HP-Edit: A Human-Preference Post-Training Framework for Image Editing

- 현재글 : [논문리뷰] LoopCTR: Unlocking the Loop Scaling Power for Click-Through Rate Prediction

- 다음글 [논문리뷰] MM-JudgeBias: A Benchmark for Evaluating Compositional Biases in MLLM-as-a-Judge

댓글