[논문리뷰] Reasoning Shift: How Context Silently Shortens LLM Reasoning

링크: 논문 PDF로 바로 열기

저자: Gleb Rodionov

## 1. Key Terms & Definitions (핵심 용어 및 정의)

- Chain-of-Thought (CoT) : LLM이 최종 답변을 도출하기 전, 중간 추론 과정을 단계별로 생성하는 기법입니다.

- Test-time Scaling : 모델의 추론(Inference) 단계에서 추가적인 연산 자원을 투입하여 성능을 개선하는 전략입니다.

- Reasoning Trace : 모델이 문제를 해결하기 위해 생성한 전체 추론 과정의 텍스트 토큰 집합을 의미합니다.

- Self-verification : 모델이 자신의 추론 과정을 스스로 검증하고 오류를 수정하는 고차원적 인지 행동 패턴입니다.

## 2. Motivation & Problem Statement (연구 배경 및 문제 정의) 본 논문은 다양한 Context 환경이 모델의 추론 행동 패턴에 미치는 영향력을 규명하고자 합니다. 기존의 연구들은 모델이 단독으로 문제를 해결할 때 충분한 추론을 수행한다는 점을 전제로 했으나, 실제 실무 환경에서는 불필요하게 긴 Context나 독립적인 여러 Subtask가 포함된 복잡한 입력이 주어지기도 합니다. 저자들은 이러한 Context 환경의 변화가 모델의 내부 추론 메커니즘을 본질적으로 변화시키는지, 즉 'Reasoning Shift'가 발생하는지를 분석합니다. 특히 단순한 입력 환경과 비교하여 복잡한 컨텍스트 환경에서 모델이 생성하는 추론 토큰의 양과 질이 어떻게 변화하는지 파악하는 것이 연구의 핵심입니다.

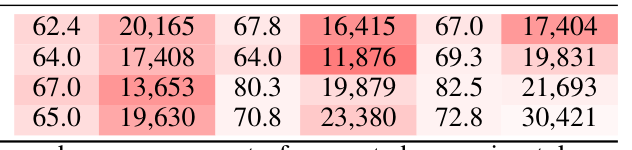

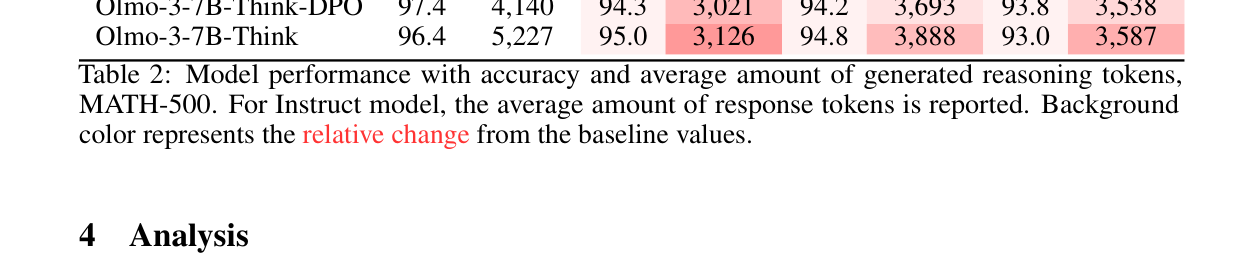

## 3. Method & Key Results (제안 방법론 및 핵심 결과) 본 연구는 모델이 동일한 문제를 Baseline, Subtask, Long input, Multi-turn 등 서로 다른 4가지 Context 조건에서 해결하도록 설계하여 추론 성능과 생성된 토큰 수를 측정했습니다. 실험 결과, 모델은 고립된 환경(Baseline) 대비 다른 조건들에서 최대 50%까지 짧은 추론 트레이스를 생성하는 현상을 보였습니다. 이는 특히 고차원적인 인지 행동인 self-verification 및 uncertainty management 의 빈도 감소와 직접적으로 연관되어 있습니다

또한, MATH500 벤치마크를 통해 검증한 결과, 이러한 추론 토큰의 압축은 단순 문제에서는 정확도에 큰 영향을 미치지 않으나, 도전적인 과제에서는 유의미한 성능 하락으로 이어짐을 확인했습니다

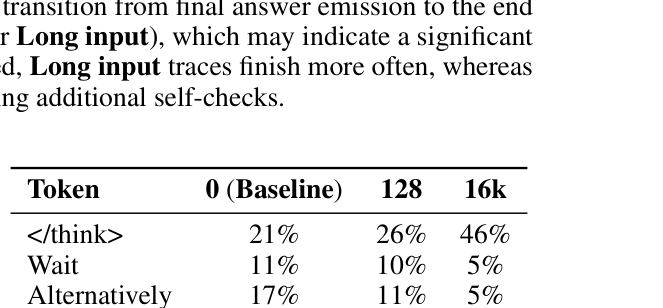

Resampling 실험을 통해 확인한 결과, 컨텍스트가 길어질수록 'Wait', 'Alternatively', 'But'과 같이 추론을 검증하는 단어의 빈도가 현저히 줄어들며, 이는 모델의 'Overthinking'이 억제되는 동시에 추론의 깊이가 얕아지는 결과를 초래합니다

## 4. Conclusion & Impact (결론 및 시사점) 본 논문은 Context 환경이 모델의 추론 행동을 은밀하게 변화시켜, 고차원적 추론 능력을 억제할 수 있다는 사실을 밝혀냈습니다. 이러한 'Reasoning Shift' 현상은 LLM 및 LLM 기반 에이전트의 Context 관리 전략에 중요한 시사점을 제공합니다. 연구진은 단순히 모델의 성능 지표뿐만 아니라, 추론 과정에서의 행동 변화를 모니터링하는 것이 모델의 Robustness 확보에 필수적임을 강조합니다. 향후 연구에서는 이러한 추론 저하를 방지하기 위한 프롬프트 튜닝이나 컨텍스트 최적화 기술 개발이 긴요할 것으로 기대됩니다.

⚠️ 알림: 이 리뷰는 AI로 작성되었습니다.

관련 포스트

- [논문리뷰] InftyThink+: Effective and Efficient Infinite-Horizon Reasoning via Reinforcement Learning

- [논문리뷰] The Markovian Thinker

- [논문리뷰] Unlocking Complex Visual Generation via Closed-Loop Verified Reasoning

- [논문리뷰] LLaTiSA: Towards Difficulty-Stratified Time Series Reasoning from Visual Perception to Semantics

- [논문리뷰] Learning Adaptive Reasoning Paths for Efficient Visual Reasoning

Review 의 다른글

- 이전글 [논문리뷰] QuitoBench: A High-Quality Open Time Series Forecasting Benchmark

- 현재글 : [논문리뷰] Reasoning Shift: How Context Silently Shortens LLM Reasoning

- 다음글 [논문리뷰] Revision or Re-Solving? Decomposing Second-Pass Gains in Multi-LLM Pipelines

댓글