[논문리뷰] Mixture of Style Experts for Diverse Image Stylization

링크: 논문 PDF로 바로 열기

저자: Shihao Zhu, Ziheng Ouyang, Yijia Kang, Qilong Wang, Mi Zhou, et al.

1. Key Terms & Definitions (핵심 용어 및 정의)

- Diffusion-based Stylization : Diffusion 모델을 기반으로 하는 이미지 스타일 전이 기법으로, 이미지의 내용(content)을 유지하면서 참조 이미지의 스타일을 적용하는 것을 목표로 합니다.

- Mixture of Experts (MoE) : 여러 개의 "전문가(expert)" 네트워크와 하나의 "라우터(router)" 네트워크로 구성된 모델 아키텍처입니다. 라우터가 입력에 따라 특정 전문가 또는 전문가 조합을 활성화하여 태스크를 처리합니다.

- LoRA (Low-Rank Adaptation) : 대규모 사전 훈련된 모델의 파인 튜닝 시 사용되는 효율적인 적응(adaptation) 기법으로, 적은 수의 파라미터만 훈련하여 모델을 특정 태스크에 맞게 조정합니다.

- InfoNCE Loss : Contrastive Learning에서 사용되는 손실 함수 중 하나로, 긍정적인(positive) 샘플 쌍은 가깝게, 부정적인(negative) 샘플 쌍은 멀게 임베딩 공간에 배치되도록 학습시킵니다.

- Style Encoder : 스타일 이미지를 입력받아 해당 스타일의 특징을 압축된 Latent Vector로 인코딩하는 네트워크입니다.

2. Motivation & Problem Statement (연구 배경 및 문제 정의)

기존의 Diffusion-based Stylization 방법론들은 이미지의 Color Transfer 에 주로 집중하여 Complex Semantics 및 Material Details 를 효과적으로 처리하지 못하는 한계가 있었습니다. 이러한 방법들은 단순히 스타일 이미지의 지배적인 색상만 전이하고, Texture나 Brushstroke와 같은 핵심 Semantic Elements 를 포착하는 데 실패했습니다. [Figure 1(a)]는 이러한 문제점을 명확히 보여줍니다. 기존 데이터셋은 스타일 카테고리 간의 Color/Semantic Imbalance 가 심하고, 스타일 정보를 모델에 주입하는 방식이 Diversity 를 반영하지 못해 모든 스타일을 균일하게 처리하는 문제가 있었습니다. 이는 Stylization 결과의 품질을 저하시키고, 복잡한 예술적 스타일을 재현하는 데 어려움을 야기했습니다.

3. Method & Key Results (제안 방법론 및 핵심 결과)

본 연구에서는 이러한 한계를 극복하기 위해 Mixture of Experts (MoE) 기반의 Semantic-aware 프레임워크인 StyleExpert 를 제안합니다. 제안하는 방법론은 두 가지 훈련 단계로 구성됩니다. 첫 번째 단계에서는 InfoNCE Loss 를 사용하여 Style Encoder 를 훈련시켜, 다양한 스타일을 효과적으로 구별하고 일반화할 수 있는 Discriminative Style Representations 를 학습합니다 [Figure 2(a)]. 이 Style Encoder 는 MoE 훈련의 초기 단계에서 안정적인 수렴과 Generalization 능력을 향상시키는 데 기여합니다. 두 번째 단계에서는 사전 훈련된 Style Encoder 의 Latent Features 를 MoE Router 의 조건부 입력으로 활용하여, 각 레이어가 다양한 스타일에 가장 적합한 LoRA Experts 를 동적으로 선택하도록 안내합니다 [Figure 2(b)].

연구팀은 또한 Content-Style-Stylized Triplets 로 구성된 500K 규모의 대규모 데이터셋을 구축했습니다. 이 데이터셋은 Hugging Face 커뮤니티의 Style-centric LoRA 모델과 CLIP 을 활용한 Style Reference Selection , 그리고 Qwen 을 통한 Quality Filtering 을 통해 Color 및 Semantic Balance 를 달성했습니다 [Figure 4].

정량적 평가에서 StyleExpert 는 기존 SOTA 방법론들을 뛰어넘는 성능을 보였습니다

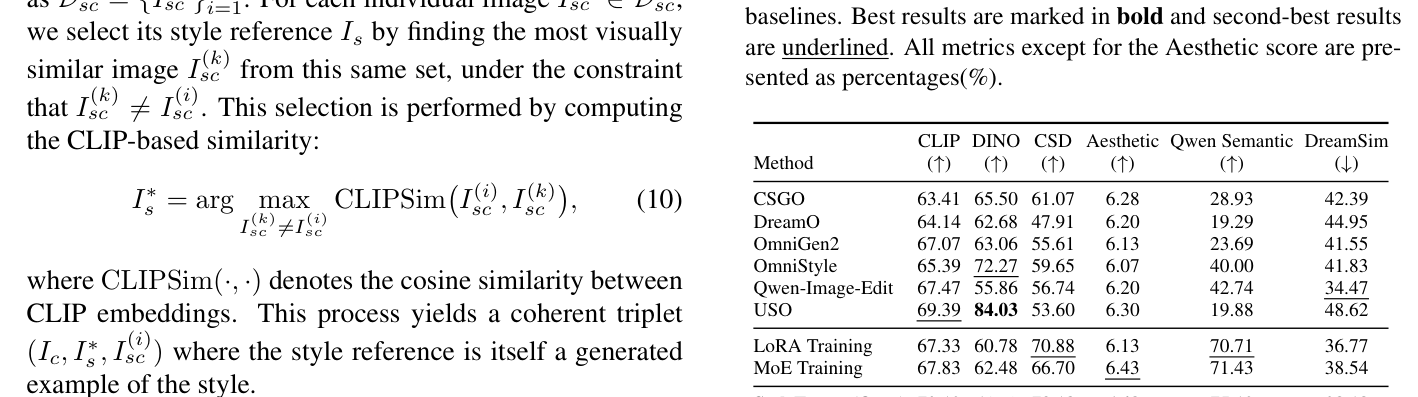

Table 1: Quantitative comparison of our method against other stylization methods, as well as LoRA-only and MoE-only fine-tuning baselines. Best results are marked in bold and second-best results are underlined. All metrics except for the Aesthetic score are presented as percentages(%).

Table 1: Quantitative comparison of our method against other stylization methods, as well as LoRA-only and MoE-only fine-tuning baselines. Best results are marked in bold and second-best results are underlined. All metrics except for the Aesthetic score are presented as percentages(%).

. 특히, Qwen Semantic Score 에서 75.12% 를 달성하며 경쟁 방법론들을 큰 폭으로 앞섰는데, 이는 복잡한 Semantic Style 전이 능력의 우수성을 입증합니다. CLIP Score , CSD Score , Aesthetic Score , DreamSim 등 다른 주요 지표에서도 최고 성능을 기록했습니다. LoRA-only 및 MoE-only 베이스라인과의 Ablation Study 결과, 사전 훈련된 Style Encoder 가 MoE 훈련의 안정성과 성능에 결정적인 역할을 한다는 것이 확인되었습니다 [Table 1, Figure 7]. 사용자 연구 결과, StyleExpert 는 74.5% 의 Top-1 Selection Rate 로 인간의 선호도에서 압도적인 우위를 차지했습니다 [Table 5].

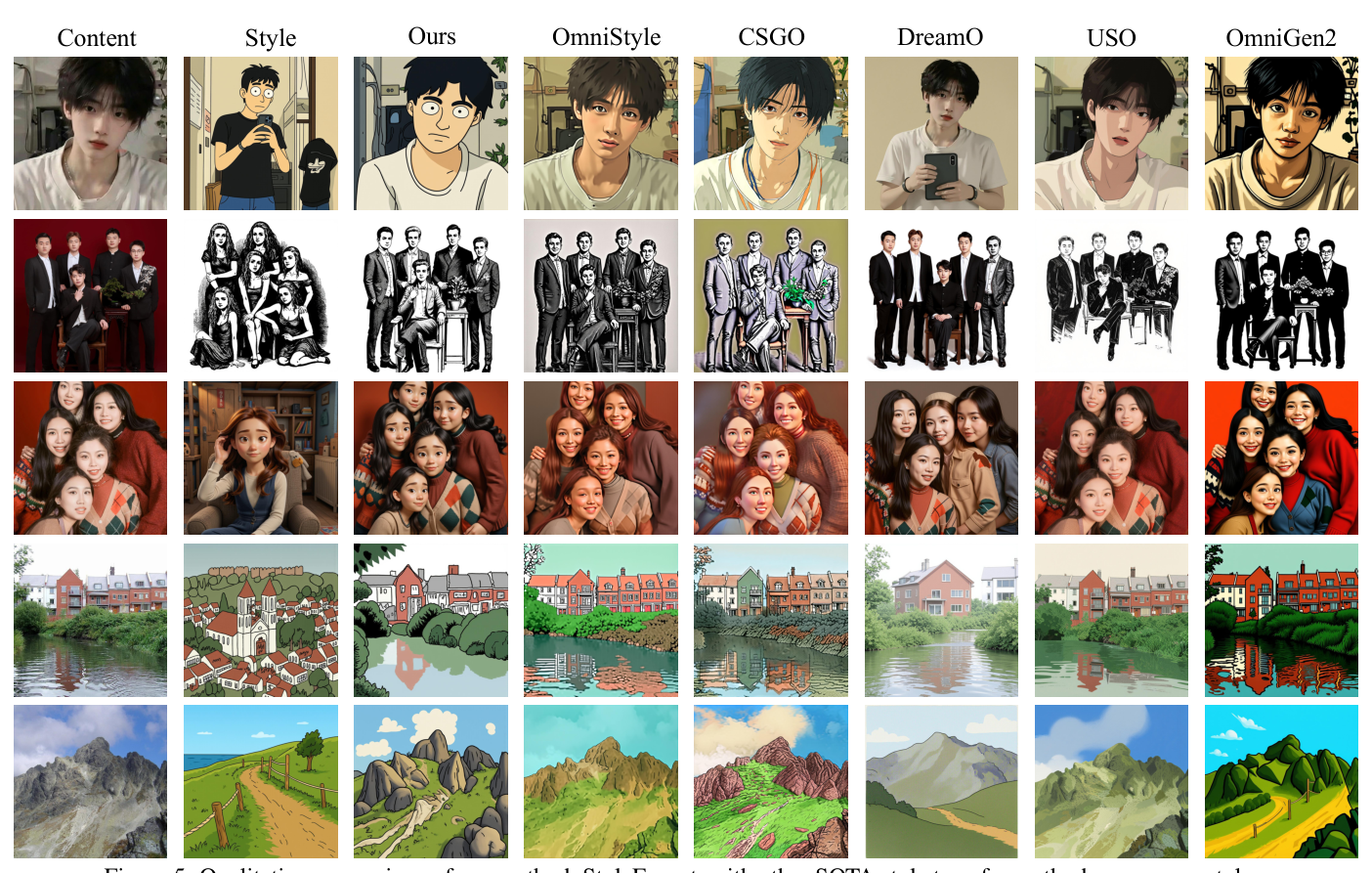

Figure 5: Qualitative comparison of our method, StyleExpert, with other SOTA style transfer methods on unseen styles.

Figure 5: Qualitative comparison of our method, StyleExpert, with other SOTA style transfer methods on unseen styles.

에서 볼 수 있듯이, StyleExpert 는 라인, 전체 분위기, 재료 등 스타일 참조 이미지의 특징을 더욱 충실하게 포착하는 Qualitative Results 를 보여주었습니다.

4. Conclusion & Impact (결론 및 시사점)

본 연구는 MoE 기반의 StyleExpert 를 제안함으로써 기존 Diffusion-based Stylization 방법론들의 한계점인 단순한 Color Transfer 를 넘어 Complex Semantics 및 Material Details 를 효과적으로 전이하는 새로운 패러다임을 제시했습니다. Pre-trained Style Encoder 와 MoE 아키텍처의 결합은 다양한 스타일, 심지어 Unseen Styles 에 대해서도 뛰어난 Style Fidelity 와 Generalization 능력을 보여줍니다. 또한, 구축된 High-quality 및 Semantic-diverse 데이터셋은 향후 Semantic Stylization 연구의 발전에 크게 기여할 것입니다. 이 연구는 Image Stylization 분야에서 Semantic Understanding 의 중요성을 강조하며, 더욱 풍부하고 표현력 있는 시각적 콘텐츠 생성을 가능하게 하여 학계 및 산업계 전반에 걸쳐 광범위한 영향을 미칠 것으로 기대됩니다.

⚠️ 알림: 이 리뷰는 AI로 작성되었습니다.

관련 포스트

- [논문리뷰] AVControl: Efficient Framework for Training Audio-Visual Controls

- [논문리뷰] ReMix: Reinforcement routing for mixtures of LoRAs in LLM finetuning

- [논문리뷰] DreamStyle: A Unified Framework for Video Stylization

- [논문리뷰] Glance: Accelerating Diffusion Models with 1 Sample

- [논문리뷰] LightsOut: Diffusion-based Outpainting for Enhanced Lens Flare Removal

Review 의 다른글

- 이전글 [논문리뷰] MiroThinker-1.7 & H1: Towards Heavy-Duty Research Agents via Verification

- 현재글 : [논문리뷰] Mixture of Style Experts for Diverse Image Stylization

- 다음글 [논문리뷰] One-Eval: An Agentic System for Automated and Traceable LLM Evaluation

댓글