[논문리뷰] StyleID: A Perception-Aware Dataset and Metric for Stylization-Agnostic Facial Identity Recognition

링크: 논문 PDF로 바로 열기

메타데이터

저자: Seungmi Lee, Youngseo Kim, Ayeong Jeong, Changmin Lee, Kwan Yun, et al.

1. Key Terms & Definitions (핵심 용어 및 정의)

- StyleID: Stylization 강도와 관계없이 인간의 인식과 일치하는 identity consistency를 유지하기 위해 제안된 perception-aware identity recognition 모델.

- StyleBench-H: 다양한 stylization method와 강도에서 인간의 동일 인물 확인(same-different verification) 판단을 수집한 벤치마크 데이터셋.

- StyleBench-S: 인간의 심리 측정적(psychometric) 인식-강도 곡선을 바탕으로 설계된, 모델 교정 및 fine-tuning을 위한 대규모 합성 데이터셋.

- 2AFC(Two-Alternative Forced-Choice): 인간 annotator가 원본 사진과 두 개의 스타일화된 후보 중 원본과 동일한 인물을 선택하게 하는 실험 프로토콜.

- LoRA(Low-Rank Adaptation): Pretrained CLIP 백본을 고정한 상태에서 style-robust identity representation을 효율적으로 학습하기 위해 사용된 적응 기법.

2. Motivation & Problem Statement (연구 배경 및 문제 정의)

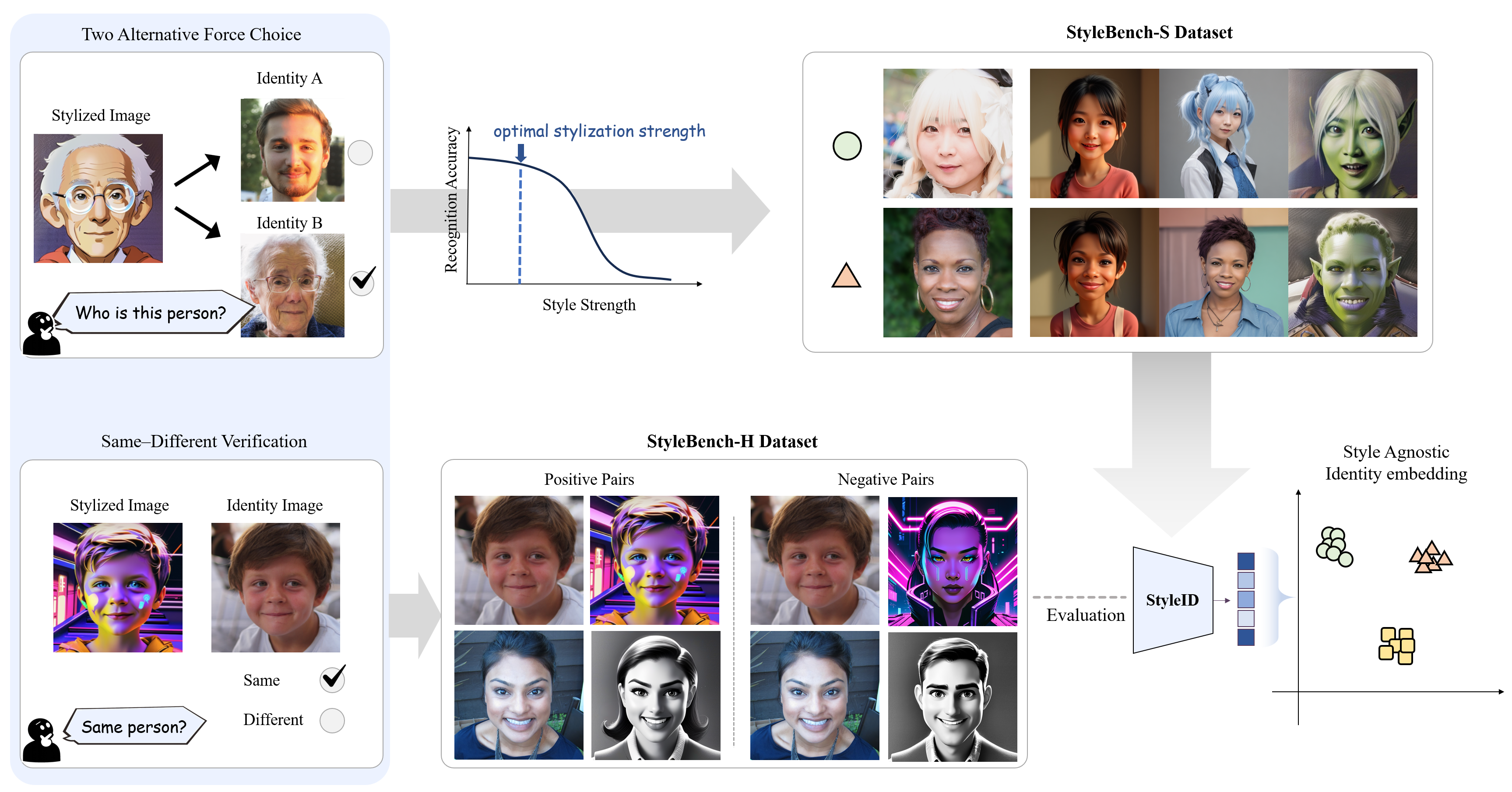

본 논문은 기존의 identity encoder들이 자연 사진(natural photograph)에 과적합되어 있어, 다양한 스타일로 변환된 인물 사진에서 identity preservation 성능이 심각하게 저하되는 문제를 해결하고자 한다. 기존의 인식 모델들은 텍스처나 색상 변화를 identity 변경으로 오인하거나, 기하학적 왜곡을 탐지하지 못하는 brittle한 특성을 보인다 [Figure 1]. 이러한 한계는 stylization 파이프라인에서 identity preservation 목표를 설정할 때 부정확한 평가로 이어진다. 저자들은 인간의 인식과 일치하는 style-agnostic 평가 및 감독 프로토콜의 부재를 문제의 핵심으로 정의한다.

Figure 1 — StyleID 프레임워크 개요

3. Method & Key Results (제안 방법론 및 핵심 결과)

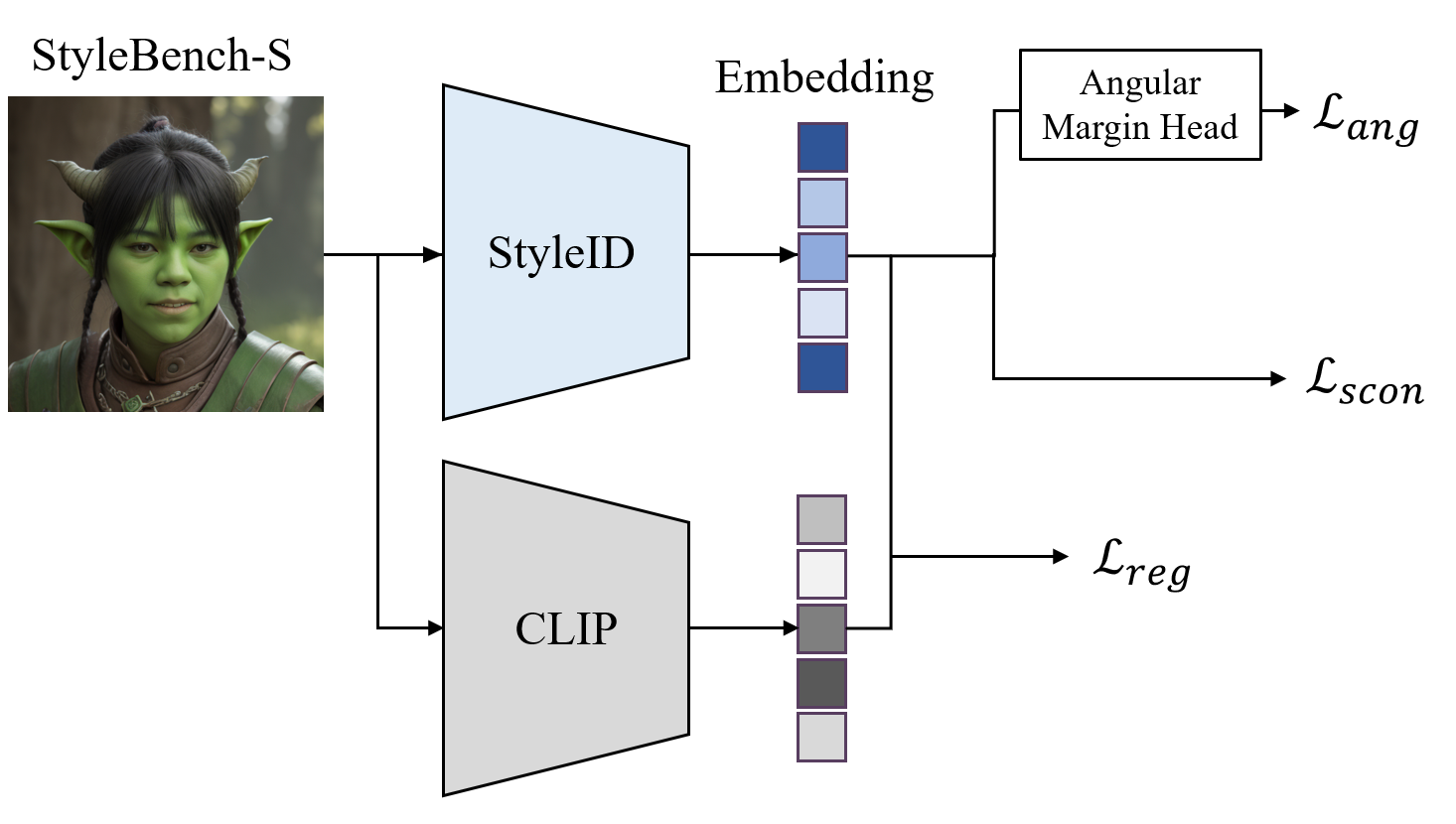

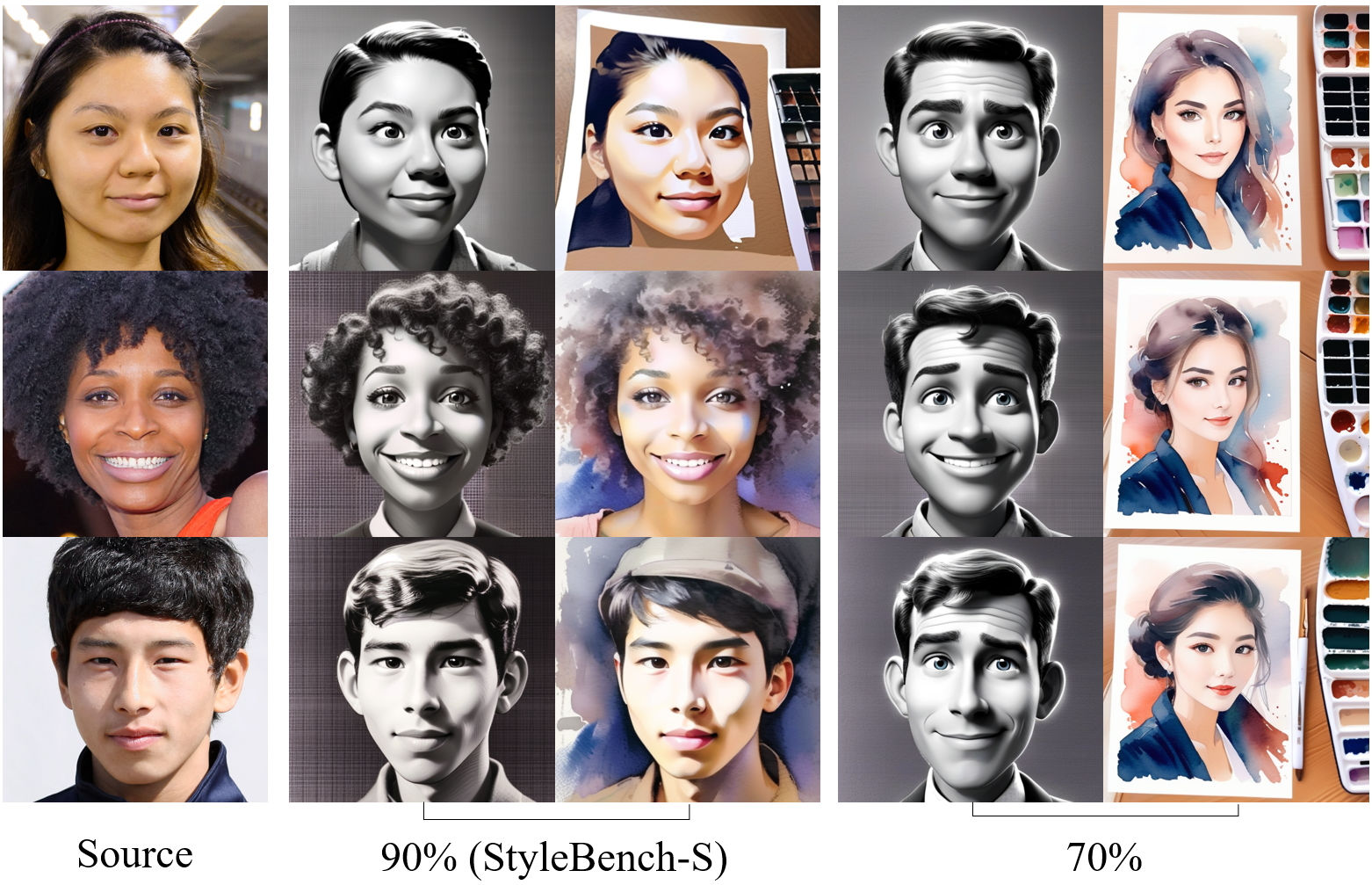

본 논문은 인간의 인식을 중심에 둔 StyleID 프레임워크를 제안하며, 이는 인간의 판단을 모사한 StyleBench-S로 CLIP 백본을 fine-tuning하는 구조를 갖는다 [Figure 7]. 저자들은 IP-Adapter, InstantID, InfiniteYou 등 최신 stylization 모델을 사용하여 다양한 강도의 샘플을 생성하고, 2AFC 실험을 통해 인간의 인식-강도(recognition-strength) 곡선을 도출하여 학습 데이터를 구축하였다. 주요 실험 결과, StyleID는 스타일화된 인물 인식 벤치마크인 StyleBench-H에서 기존 모델들 대비 월등한 성능을 보였다 [Figure 4]. 정량적 지표로, StyleID는 Cross-ID 설정에서 0.9020의 TPR을 기록하였으며, AUROC 지표에서도 기존의 ArcFace나 CLIP 대비 높은 수치를 달성하며 우월한 일반화 능력을 입증하였다 [Table 1]. 또한, 아티스트가 직접 그린 SKSF-A 데이터셋에서도 높은 TPR(0.8891)과 AUROC(0.9922)를 기록하여 극단적인 스타일 변환 환경에서도 견고함을 증명하였다 [Table 2].

Figure 7 — StyleID 학습 아키텍처

4. Conclusion & Impact (결론 및 시사점)

본 논문은 perception-aware 데이터셋인 StyleBench-H 및 StyleBench-S와 이를 활용한 StyleID 모델을 통해 stylization 환경에서의 identity 인식 문제를 체계적으로 해결하였다. 본 연구의 성과는 기존의 사진 기반 identity metric이 가진 한계를 극복하고, 인간의 인식과 일치하는 보다 안정적인 평가 기준을 제시했다는 점이다. 특히, 제안된 모델은 생성형 AI 분야에서 identity preservation을 위한 표준적인 지도 신호(supervisory signal)로 활용될 수 있는 중요한 기반을 마련했다. 향후 연구로는 더욱 다양한 인종 및 문화적 배경을 포괄하는 데이터셋 확장이 필요하며, 포즈와 폐색(occlusion) 등 추가적인 복합 변인에 대한 견고성 강화가 시사된다.

Figure 6 — 인식 임계값에 따른 샘플 비교

⚠️ 알림: 이 리뷰는 AI로 작성되었습니다.

관련 포스트

- [논문리뷰] QuitoBench: A High-Quality Open Time Series Forecasting Benchmark

- [논문리뷰] AI Generalisation Gap In Comorbid Sleep Disorder Staging

- [논문리뷰] Extending Precipitation Nowcasting Horizons via Spectral Fusion of Radar Observations and Foundation Model Priors

- [논문리뷰] MultiBind: A Benchmark for Attribute Misbinding in Multi-Subject Generation

- [논문리뷰] EffectErase: Joint Video Object Removal and Insertion for High-Quality Effect Erasing

Review 의 다른글

- 이전글 [논문리뷰] Seeing Fast and Slow: Learning the Flow of Time in Videos

- 현재글 : [논문리뷰] StyleID: A Perception-Aware Dataset and Metric for Stylization-Agnostic Facial Identity Recognition

- 다음글 [논문리뷰] Test-Time Adaptation for EEG Foundation Models: A Systematic Study under Real-World Distribution Shifts

댓글