[논문리뷰] Multimodal OCR: Parse Anything from Documents

링크: 논문 PDF로 바로 열기

저자: Handong Zheng, Yumeng Li, Kaile Zhang, Liang Xin, Zhaohui Yu, et al.

1. Key Terms & Definitions (핵심 용어 및 정의)

- MOCR (Multimodal OCR) : 텍스트와 그래픽을 통합된 텍스트 표현으로 공동으로 파싱하는 문서 파싱 패러다임. 차트, 다이어그램, 테이블, 아이콘 등 시각적 요소를 1등급 파싱 대상으로 처리하여 요소 간의 Semantic relationship을 보존합니다.

- dots.mocr : MOCR 패러다임을 구현하기 위해 개발된 Scalable system으로, PDF, Rendered webpage, Native SVG assets를 포함하는 방대한 Data engine과 Staged pre-training, Supervised fine-tuning 방법을 사용하여 학습됩니다.

- SVG (Scalable Vector Graphics) : 문서 Graphics를 표현하는 Renderable structured representation입니다. Raster crop이 아닌 재사용 및 편집 가능한 Code-level supervision으로 Graphics를 변환합니다.

- OCR Arena : LLM-as-a-Judge 패러다임 기반의 Automated evaluation framework로, 모델 출력물의 Fidelity, Structure, Formatting 등을 종합적으로 평가하여 순위를 매깁니다.

- ISVGEN score : UniSVG에서 파생된 Reconstruction-based metric으로, Rendered result와 Original image 간의 유사도를 측정하여 Image-to-SVG generation의 품질을 평가합니다.

2. Motivation & Problem Statement (연구 배경 및 문제 정의)

Large language model과 Multimodal model 시대에 문서 파싱은 Pretraining 및 Retrieval을 위한 핵심 Data engine이 되었습니다. 그러나 기존의 OCR 시스템은 Text recognition에 중점을 두어 Graphics 영역을 단순히 Cropped pixel로 처리하며, 이로 인해 문서 그래픽에 인코딩된 많은 Structural 및 Semantic information이 손실됩니다. 이는 현재 문서 파싱의 Inherently lossy한 특성을 야기하고, 문서에서 추출할 수 있는 Structured supervision의 양을 제한합니다.

저자들은 이러한 한계를 극복하고, 문서 내의 Text뿐만 아니라 Charts, Diagrams, UI elements, Icons 등 정보 밀도가 높은 Graphics까지 포함한 모든 정보를 Renderable code(예: SVG)와 같은 Structured output으로 변환하는 새로운 문서 파싱 패러다임인 MOCR을 제안합니다. 기존 연구들은 Text-centric하거나 Task-specific한 그래픽 시스템으로 분리되어 있었으며, MOCR은 이를 통합하여 Multimodal pretraining을 위한 Scalable한 Supervision source를 제공하는 것을 목표로 합니다. 하지만 그래픽스에 대한 Supervision scarcity, Renderable program의 non-unique 특성, 그리고 정밀한 Visual grounding과 Long-sequence structured generation의 어려움이라는 Scalability 문제를 해결해야 했습니다.

3. Method & Key Results (제안 방법론 및 핵심 결과)

저자들은 MOCR 패러다임을 구현하기 위해 dots.mocr 라는 Scalable system을 개발했습니다. 이 시스템은 High-resolution vision encoder (1.2B parameters) , Lightweight multimodal connector, Autoregressive LLM decoder (Qwen2.5-1.5B) 의 세 가지 핵심 구성 요소로 이루어져 있습니다. 특히 Vision encoder는 문서 파싱에 최적화된 Feature representation을 학습하기 위해 From scratch로 학습되었으며, LLM decoder는 비자연어적이고 Highly structured target sequence(예: SVG program) 생성을 위해 사용됩니다.

Training recipe는 PDF, Rendered webpage, Native SVG assets에서 수집된 방대한 데이터셋을 활용한 Staged pre-training과 Supervised fine-tuning으로 구성됩니다. 이 시스템은 시각적 요소를 Raster crop 대신 재사용 가능한 Renderable code로 변환함으로써 기존에 버려졌던 Graphics 정보를 Code-level supervision으로 활용합니다. 또한, 생성된 코드와 Rendering fidelity를 일치시키기 위한 Normalization 및 Quality control 메커니즘을 적용하여 Scalability 문제를 해결합니다.

dots.mocr 의 핵심 결과는 다음과 같습니다:

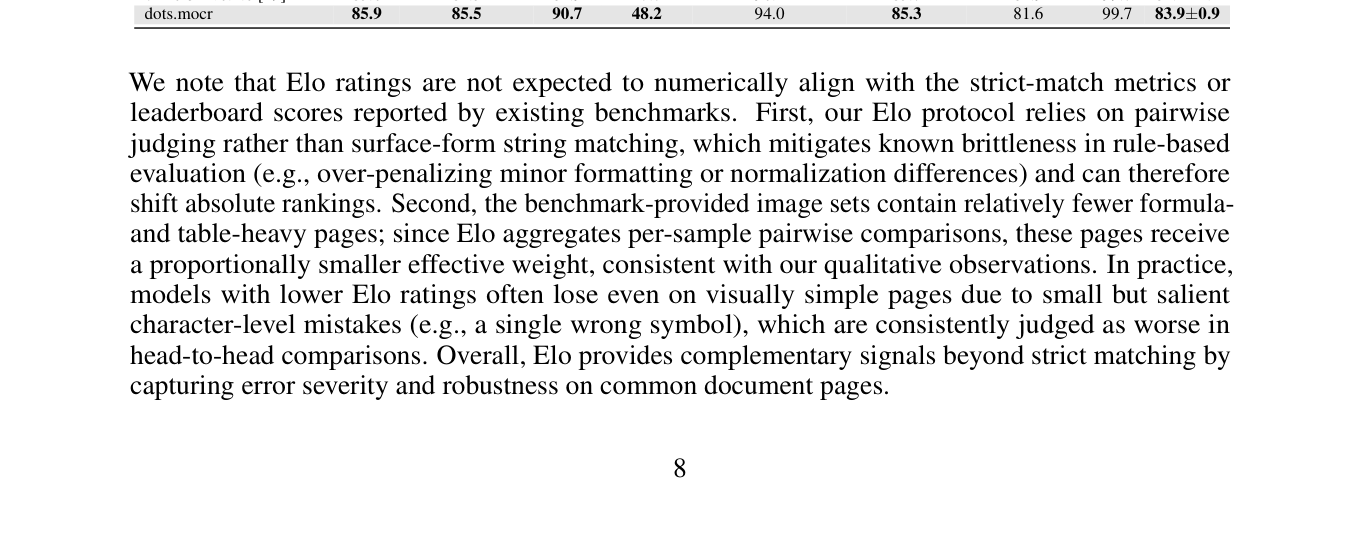

- 문서 파싱 성능 : OCR Arena Elo leaderboard에서 Gemini 3 Pro 에 이어 2위를 차지하며 Open-source 문서 파싱 시스템을 능가했습니다. 특히 olmOCR Bench 에서는 83.9 의 새로운 State-of-the-art 성능을 달성했으며, 이는 이전 SOTA 모델인 Infinity-Parser 7B의 82.5와 olmOCR v0.4.0의 82.4를 뛰어넘는 수치입니다.

Table 3: Performance comparison on olmOCR-Bench.

Table 3: Performance comparison on olmOCR-Bench.

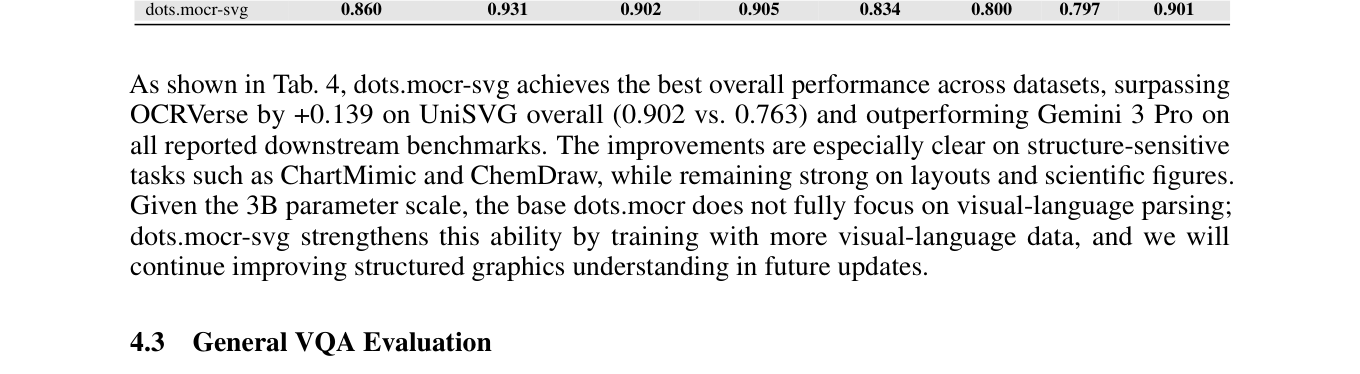

- Structured Graphics Parsing 성능 : Image-to-SVG 벤치마크에서 Gemini 3 Pro 보다 높은 Reconstruction quality를 보였습니다. 특히 dots.mocr-svg 는 UniSVG Overall에서 0.902 의 성능을 달성하여 OCRVerse (0.763) 및 Gemini 3 Pro (0.735)를 크게 상회했습니다.

Table 4: ISVGEN reconstruction scores on UniSVG (low-level, high-level, overall) and downstream visual-language benchmarks (higher is better).

Table 4: ISVGEN reconstruction scores on UniSVG (low-level, high-level, overall) and downstream visual-language benchmarks (higher is better).

- 범용 Visual Question Answering (VQA) 성능 : CharXiv, InfoVQA, DocVQA, ChartQA 등 다양한 VQA 벤치마크에서 경쟁력 있는 성능을 유지하며 Multimodal reasoning 능력의 균형을 입증했습니다.

4. Conclusion & Impact (결론 및 시사점)

본 연구는 Multimodal OCR (MOCR)이라는 새로운 문서 파싱 패러다임을 도입하여, 문서 파싱의 범위를 텍스트 추출에서 모든 정보 전달 요소를 구조적으로 이해하는 방향으로 확장합니다. MOCR은 기존 시스템이 Raster crop으로 처리하고 구조적으로 해석하지 못했던 Charts, Diagrams, Icons 등 시각적 요소를 First-class parsing target으로 삼고, 이를 재사용 가능한 Renderable structured code(예: SVG)로 복구합니다. 이 핵심적인 접근 방식은 많은 문서에서 가장 풍부한 Supervision이 시각적 형태임에도 불구하고, 기존 OCR Pipeline에서는 역사적으로 버려졌던 정보를 재활용할 수 있게 합니다.

MOCR은 Graphics를 실행 가능한 SVG 프로그램으로 복구함으로써 Static document pixel을 Reasoning 및 Learning에 재사용할 수 있는 Structured supervision으로 변환합니다. 이는 문서 파싱의 Scope를 넓힐 뿐만 아니라, 방대한 문서 코퍼스에서 추출할 수 있는 Usable supervision의 양을 증가시킵니다. 더 나아가, 본 연구는 문서 파싱을 Text-centric OCR에서 인간 지식의 완전한 시각적 언어를 포착하는 Document-native multimodal parsing으로 전환하는 데 기여하며, Large multimodal pretraining corpus 구축을 위한 Scalable pipeline을 제공합니다.

⚠️ 알림: 이 리뷰는 AI로 작성되었습니다.

관련 포스트

- [논문리뷰] Unlocking Dense Metric Depth Estimation in VLMs

- [논문리뷰] MemEye: A Visual-Centric Evaluation Framework for Multimodal Agent Memory

- [논문리뷰] CurveBench: A Benchmark for Exact Topological Reasoning over Nested Jordan Curves

- [논문리뷰] RoboEvolve: Co-Evolving Planner-Simulator for Robotic Manipulation with Limited Data

- [논문리뷰] Sparse Autoencoders as Plug-and-Play Firewalls for Adversarial Attack Detection in VLMs

Review 의 다른글

- 이전글 [논문리뷰] MM-CondChain: A Programmatically Verified Benchmark for Visually Grounded Deep Compositional Reasoning

- 현재글 : [논문리뷰] Multimodal OCR: Parse Anything from Documents

- 다음글 [논문리뷰] OmniForcing: Unleashing Real-time Joint Audio-Visual Generation

댓글