[논문리뷰] MemMA: Coordinating the Memory Cycle through Multi-Agent Reasoning and In-Situ Self-Evolution

링크: 논문 PDF로 바로 열기

저자: Minhua Lin, Zhiwei Zhang, Hanqing Lu, Hui Liu, Xianfeng Tang, Qi He, Xiang Zhang, Suhang Wang, et al.

1. Key Terms & Definitions (핵심 용어 및 정의)

- Memory Cycle Effect : LLM Agent의 장기 기억 시스템에서 정보의 Construction, Retrieval, Utilization이 상호 연결되어 순환하는 동적인 과정을 의미합니다. 이 세 단계가 효과적으로 조율될 때 Agent의 성능이 최적화됩니다.

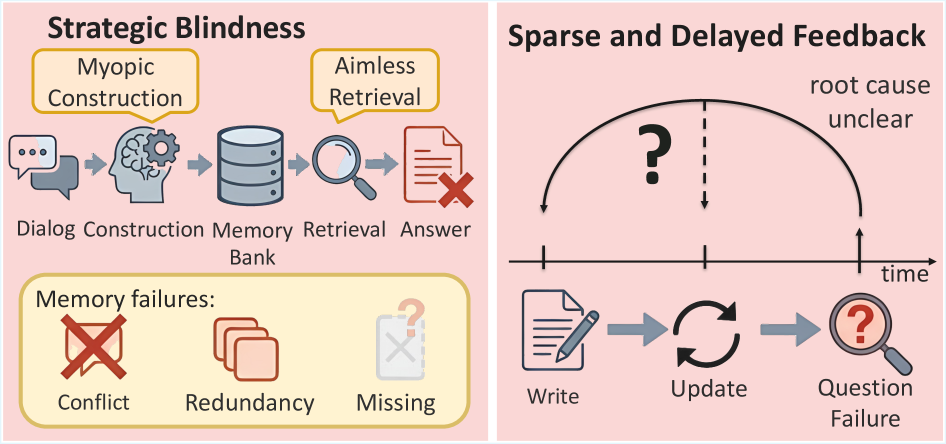

- Strategic Blindness : 기존 메모리 증강 LLM Agent들이 메모리 수정 및 검색 쿼리를 실행하는 메커니즘은 갖추고 있으나, 하위 Question Answering을 위한 명시적인 Meta-cognition이나 전략적 추론이 부족하여 발생하는 한계점을 지칭합니다. 이는 Myopic Construction과 Aimless Retrieval로 발현됩니다.

- Myopic Construction : Agent가 정보를 무분별하게 추가, 덮어쓰거나 무시하여 중복성(Redundancy)과 충돌(Conflicts)이 해결되지 않은 채로 메모리 뱅크에 축적되는 현상입니다.

- Aimless Retrieval : 초기 쿼리가 불완전하거나 저장된 메모리와 의미적으로 불일치할 때, 단발성 검색이나 피상적인 재작성으로는 필요한 증거를 찾아내지 못하는 상황을 의미합니다.

- In-situ Self-Evolving Memory Construction : 각 세션 직후 Probe QA pairs 를 합성하여 현재 메모리를 검증하고, 실패(Failures)를 메모리 뱅크 수리(Repair actions)로 전환하는 MemMA 의 핵심 메커니즘입니다. 이는 메모리가 확정되기 전에 문제점을 즉각적으로 해결합니다.

2. Motivation & Problem Statement (연구 배경 및 문제 정의)

Large Language Models (LLMs) 기반의 Agent들이 장기적인 상호작용을 지원하기 위해 외부 메모리 뱅크를 활용하지만, 대부분의 기존 시스템은 메모리 Construction , Retrieval , Utilization 단계를 개별적인 서브루틴으로 분리하여 처리하는 한계를 가집니다. 이러한 분리된 접근 방식은 두 가지 주요 문제를 야기합니다.

첫째, 메모리 사이클의 Forward Path 에서는 메모리 Construction 및 Retrieval이 명시적인 전략적 추론보다는 국소적인 휴리스틱(Local heuristics)에 의해 구동되어 Strategic Blindness 가 발생합니다. 이는 Myopic Construction (정보의 근시안적 축적 및 충돌)과 Aimless Retrieval (목표 없는 반복 검색)이라는 두 가지 병폐로 나타납니다. 둘째, Backward Path 에서는 이용(Utilization) 단계의 실패가 메모리 뱅크에 대한 직접적인 수정으로 이어지는 피드백이 Sparse and Delayed Supervision 으로 작용하여, 초기 오류가 장기적으로 전파되는 문제를 발생시킵니다. 저자들은 이러한 기존 연구의 한계점을 극복하기 위해 메모리 사이클의 모든 단계를 조율하는 새로운 프레임워크의 필요성을 제기합니다.

3. Method & Key Results (제안 방법론 및 핵심 결과)

저자들은 이러한 문제들을 해결하기 위해 MemMA (Memory Cycle Multi-Agent Coordination) 라는 플러그 앤 플레이(Plug-and-Play) 멀티 에이전트 프레임워크를 제안합니다.

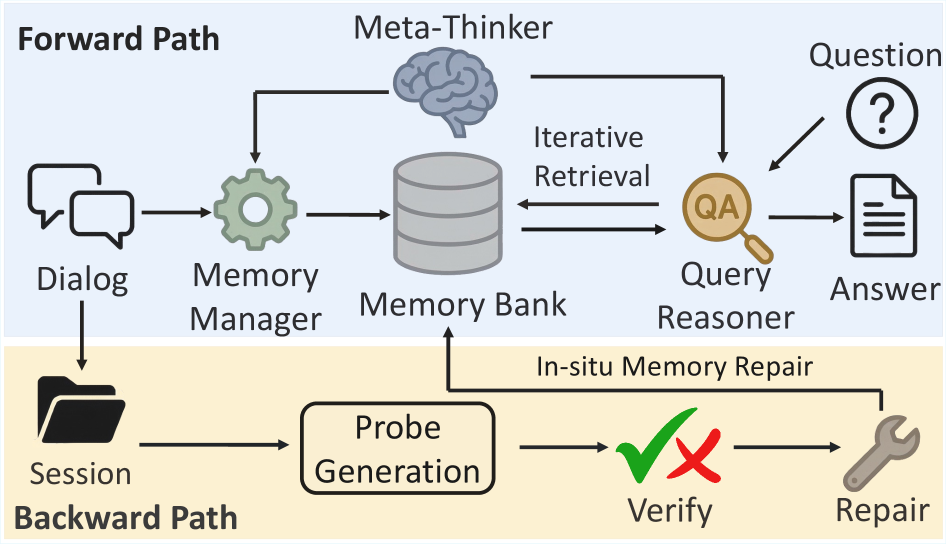

MemMA 는 메모리 사이클의 Forward Path 와 Backward Path 를 모두 조율합니다.

Forward Path 에서는 전략적 추론을 저수준 실행(Low-level execution)과 분리하는 플래너-워커(Planner-Worker) 아키텍처를 사용합니다. Meta-Thinker (πp) 는 높은 수준의 전략적 추론을 담당하여, 메모리 Construction 시 Memory Manager (πs) 에게 무엇을 유지, 통합, 해결할지에 대한 구조화된 지침(Structured guidance)을 제공하여 Myopic Construction을 완화합니다. 또한, Query Reasoner (πr)에게 누락된 증거(Missing evidence)를 진단하고 이를 검색하는 방법을 지시하여, 단발성 검색(One-shot search) 대신 진단 기반의 반복적인 개선(Diagnosis-guided iterative refinement)을 통해 Aimless Retrieval을 완화합니다. Query Reasoner (πr) 는 Meta-Thinker의 지침에 따라 Refine-and-Probe 반복 루프를 구현하여 검색 쿼리를 개선하고 보충 증거를 검색합니다.

Backward Path 에서는 In-situ Self-Evolving Memory Construction 을 도입합니다. 각 세션 후에 시스템은 Probe QA pairs 를 합성하여 현재 메모리를 검증하고, 실패(Failures)를 Evidence-grounded Critique 및 Semantic Consolidation 을 통한 메모리 뱅크 수리 작업으로 전환합니다. 이는 메모리가 이후 사용을 위해 커밋(Committed)되기 전에 이루어져, 희소하고 지연된 피드백 문제를 해결하고 결함 있는 메모리가 미래 업데이트로 전파되는 것을 방지합니다.

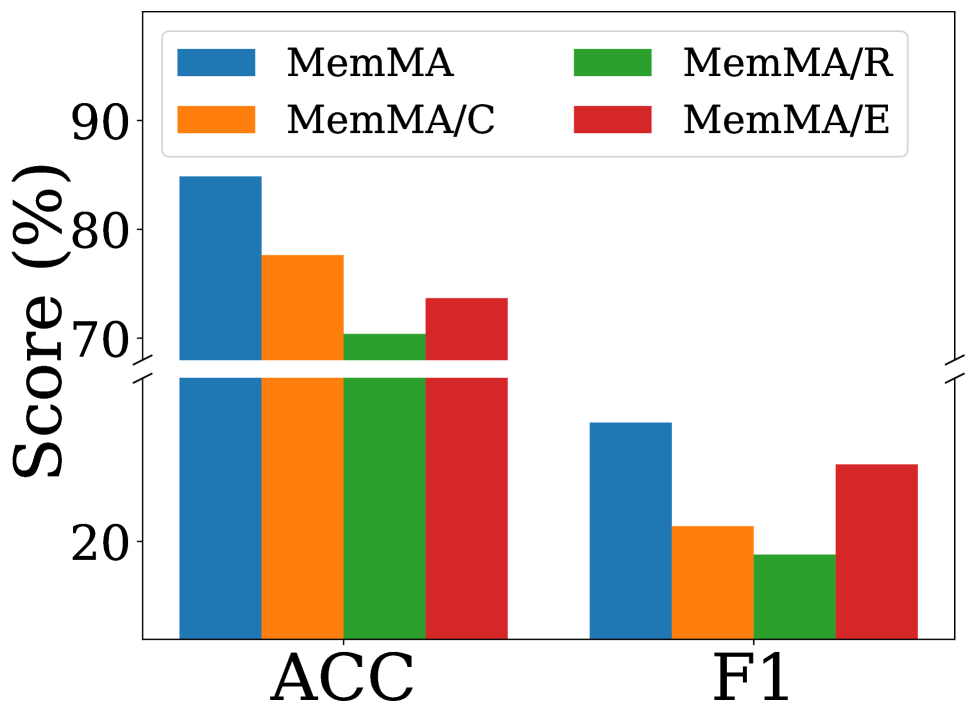

실험은 장기 대화형 메모리 벤치마크인 LoCoMo 데이터셋에서 수행되었으며, MemMA 는 다양한 LLM 백본(Backbones)인 GPT-4o-mini 및 Claude-Haiku-4.5 에서 기존 베이스라인 대비 일관되게 우수한 성능을 보였습니다. 특히, GPT-4o-mini 백본에서 MemMA 는 전체적으로 49.40 F1 , 38.28 B1 , 81.58 ACC 를 달성하여, 가장 강력한 베이스라인인 LightMem 보다 F1 에서 +4.82% , B1 에서 +1.62% , ACC 에서 +5.92% 향상된 결과를 보여주었습니다. [Table 2] 또한, MemMA 는 Single-Agent , A-Mem , LightMem 세 가지 상이한 스토리지 백엔드(Storage backends)를 플러그 앤 플레이 방식으로 일관되게 개선합니다. [Table 3] Ablation Study 결과에 따르면, 반복 검색(Iterative retrieval)이 Forward Path 에서 가장 중요한 구성 요소이며, In-situ Self-Evolving Memory Construction이 메모리 Construction 단계의 누락을 효과적으로 수리하는 데 크게 기여함이 확인되었습니다. [Figure 3(a)]

4. Conclusion & Impact (결론 및 시사점)

본 논문은 MemMA 라는 플러그 앤 플레이 멀티 에이전트 프레임워크를 통해 LLM Agent의 메모리 사이클을 Forward Path 와 Backward Path 양쪽에서 효과적으로 조율하는 방법을 제시합니다. Meta-Thinker 가 전략적 추론을 담당하여 Construction 과 Retrieval 과정의 Strategic Blindness 를 해결하며, In-situ Self-Evolving Memory Construction 은 Probe QA 실패를 직접적인 메모리 수리(Direct memory repair)로 전환하여 지연된 피드백 문제를 해소합니다. LoCoMo 벤치마크에 대한 광범위한 실험을 통해 MemMA 가 기존 베이스라인을 뛰어넘고 다양한 스토리지 백엔드에서 일관된 성능 향상을 입증했습니다. 이 연구는 LLM Agent의 장기적인 기억 관리 능력을 향상시키는 강력한 솔루션을 제공하며, 향후 Agent 시스템이 더 복잡하고 장기적인 태스크를 효과적으로 수행하는 데 중요한 시사점을 줍니다.

⚠️ 알림: 이 리뷰는 AI로 작성되었습니다.

관련 포스트

- [논문리뷰] Memex(RL): Scaling Long-Horizon LLM Agents via Indexed Experience Memory

- [논문리뷰] TIDE: Trajectory-based Diagnostic Evaluation of Test-Time Improvement in LLM Agents

- [논문리뷰] Toward Efficient Agents: Memory, Tool learning, and Planning

- [논문리뷰] EvoFSM: Controllable Self-Evolution for Deep Research with Finite State Machines

- [논문리뷰] MemoBrain: Executive Memory as an Agentic Brain for Reasoning

Review 의 다른글

- 이전글 [논문리뷰] MSA: Memory Sparse Attention for Efficient End-to-End Memory Model Scaling to 100M Tokens

- 현재글 : [논문리뷰] MemMA: Coordinating the Memory Cycle through Multi-Agent Reasoning and In-Situ Self-Evolution

- 다음글 [논문리뷰] MuRF: Unlocking the Multi-Scale Potential of Vision Foundation Models

댓글