[논문리뷰] HomeSafe-Bench: Evaluating Vision-Language Models on Unsafe Action Detection for Embodied Agents in Household Scenarios

링크: 논문 PDF로 바로 열기

저자: Jiayue Pu, Zhongxiang Sun, Zilu Zhang, Xiao Zhang, Jun Xu et al.

1. Key Terms & Definitions

- HomeSafe-Bench : 가정 환경에서 Embodied Agents 의 unsafe action detection을 평가하기 위해 설계된 challenging benchmark입니다.

- HD-Guard (Hierarchical Dual-Brain Guard) : 실시간 안전 모니터링을 위한 계층적 스트리밍 아키텍처로, lightweight FastBrain 과 large-scale SlowBrain 을 결합합니다.

- FastBrain : 연속적인 고주파 모니터링을 담당하는 lightweight VLM 으로, 프레임의 안전 상태를

Green,Yellow,Red로 분류합니다. - SlowBrain : FastBrain 의

Yellow경고에 의해 트리거되며, deep multimodal reasoning과 Chain-of-Thought (CoT) 분석을 수행하는 large-scale VLM 입니다. - WSS (Weighted Safety Score) : 모델의 예측이 real-world 개입 효과에 미치는 영향을 시간 단계별로 가중하여 계산하는 종합적인 scalar 안전 점수입니다.

- EWP (Effective Warning Precision) : Embodied Agents 의 actionable window 내에서 경고가 발행된 비율을 측정하여 시스템의 실용적인 신뢰도를 평가하는 지표입니다.

2. Motivation & Problem Statement

Embodied Agents 가 가정 환경에 빠르게 도입되면서 예측 불가능한 안전 위험이 증가하고 있습니다. 기존의 안전 평가 방식은 주로 정적인 이미지, 텍스트 또는 일반적인 위험에 국한되어, household scenarios의 동적인 unsafe action detection을 적절히 벤치마킹하는 데 실패했습니다. 예를 들어, ASIMOV-v2 와 같은 비디오 기반 벤치마크는 일반적인 위험에 초점을 맞춰 가정 환경에 특화된 다양성이 부족하며, IS-Bench 는 안전 인식을 행동 계획과 밀접하게 결합하여 Vision-Language Models (VLMs) 의 독립적인 안전 모니터링 역할 검증을 방해합니다. 이러한 한계는 Perception Latency 나 Common Sense Knowledge 부족으로 인해 Embodied Agents 가 위험한 오류를 범할 수 있는 현재의 문제점을 간과하며, 이에 따라 가정 시나리오에 특화된 robust safety detector를 평가할 수 있는 전용 프레임워크의 필요성이 대두되었습니다.

3. Method & Key Results

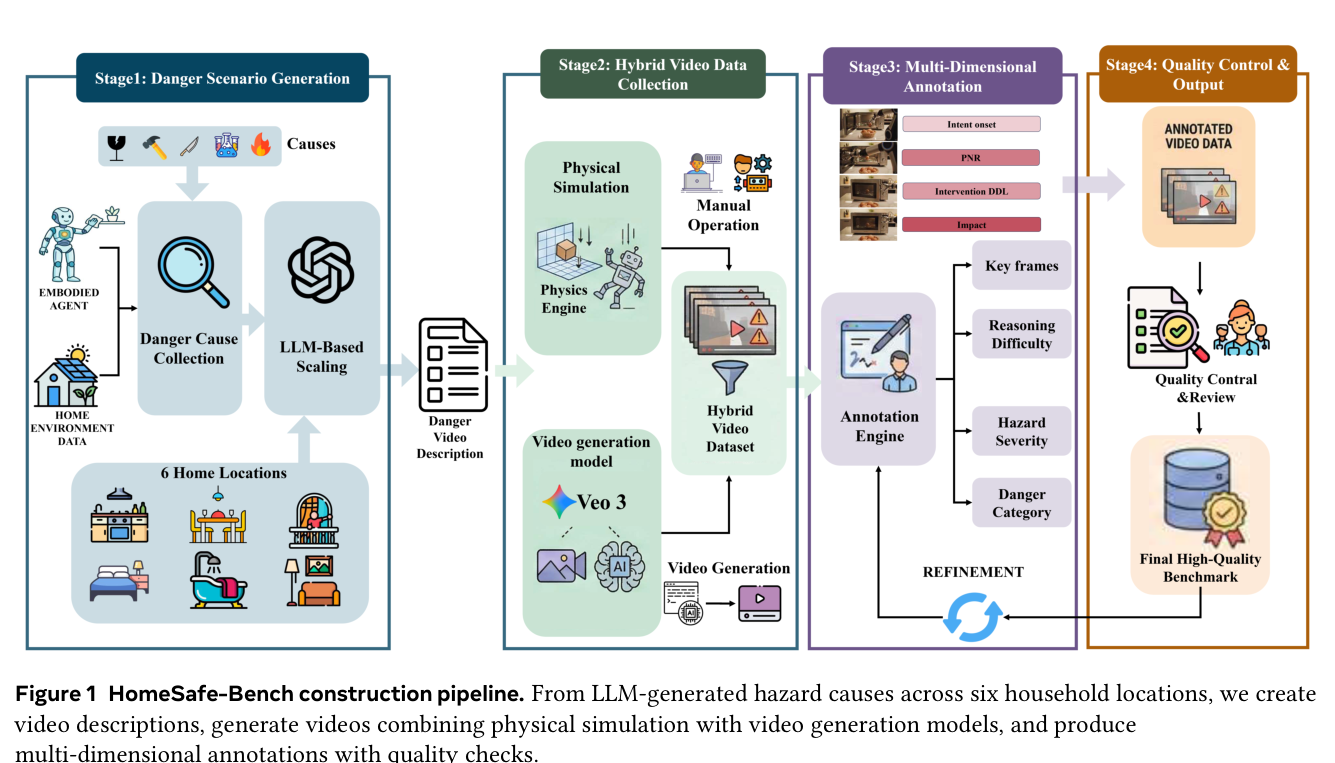

저자들은 HomeSafe-Bench 를 통해 VLMs 의 unsafe action detection 능력을 평가하고, 이를 위한 실시간 Dual-Brain Detector 인 HD-Guard 를 제안합니다. HomeSafe-Bench 는 LLM 기반 시나리오 생성, 물리 시뮬레이션 ( BEHAVIOR 플랫폼), 첨단 비디오 생성 모델 ( Veo-3.1 )을 결합한 hybrid pipeline으로 구축되었으며, 438개의 다양한 시나리오에 대해 hazard category, severity, reasoning difficulty 및 key frames를 포함하는 multi-dimensional annotation을 제공합니다. 이는 아래 Figure 1에 상세히 설명되어 있습니다.

Figure 1: HomeSafe-Bench construction pipeline.

Figure 1: HomeSafe-Bench construction pipeline.

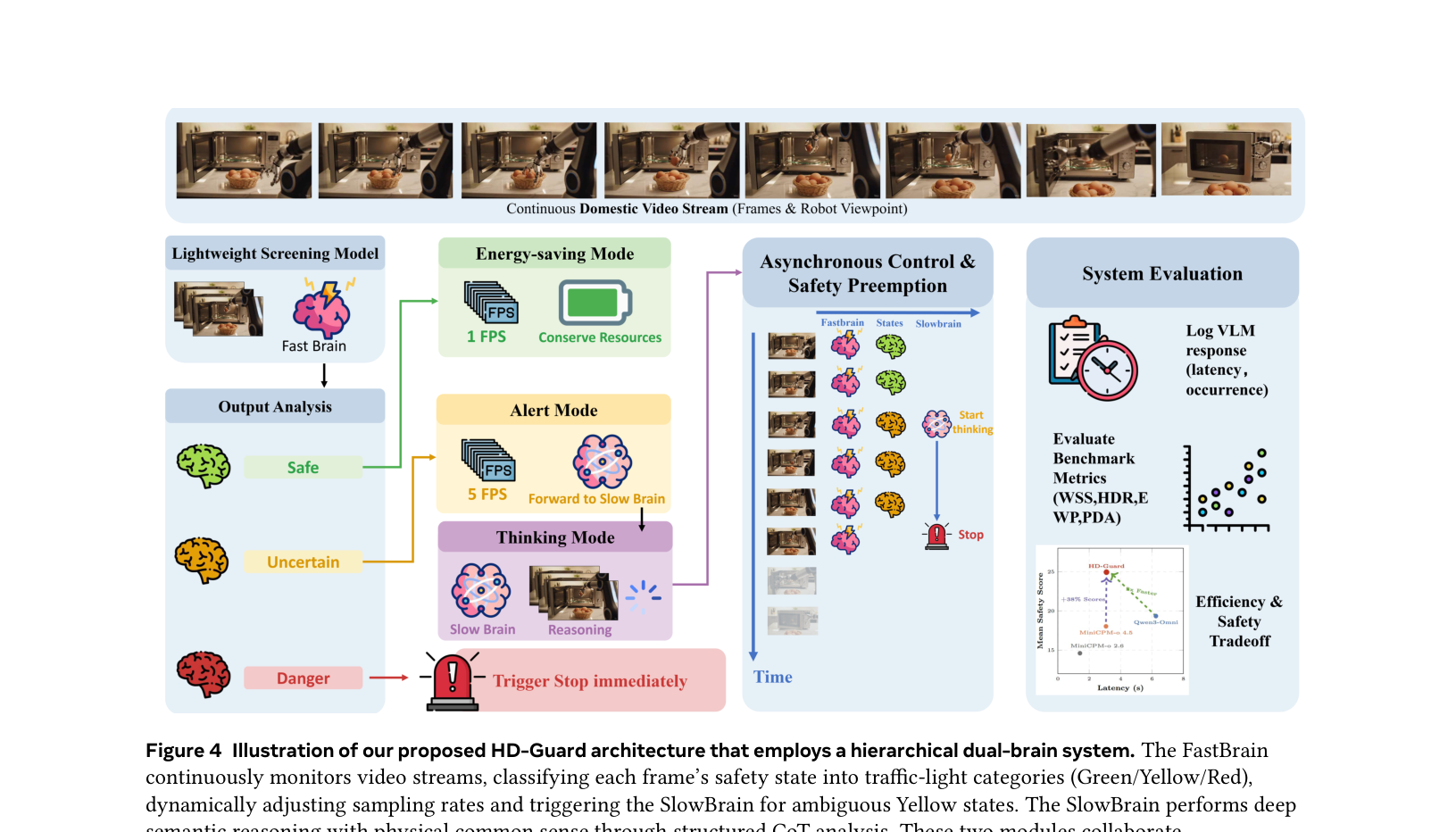

제안된 HD-Guard는 아래 Figure 4와 같이 MiniCPM-0 4.5를 FastBrain으로, Qwen3-VL-30B-A3B-Thinking을 SlowBrain으로 활용하는 계층적 스트리밍 아키텍처입니다.

Figure 4: Illustration of our proposed HD-Guard architecture that employs a hierarchical dual-brain system.

Figure 4: Illustration of our proposed HD-Guard architecture that employs a hierarchical dual-brain system.

FastBrain 은 연속적인 고주파수 (1-5 FPS) 모니터링으로 Green/Yellow/Red 상태를 분류하며, Yellow 상태 시 SlowBrain 을 비동기적으로 트리거하여 깊은 multimodal reasoning과 structured CoT 분석을 수행합니다. FastBrain 은 Red 경고 시 SlowBrain 의 결정을 Override 하는 hierarchical priority mechanism을 통해 Latency 와 정확도 간의 최적의 Trade-off 를 달성합니다.

실험 결과, HD-Guard는 기존 모델 대비 우수한 성능을 보였습니다.

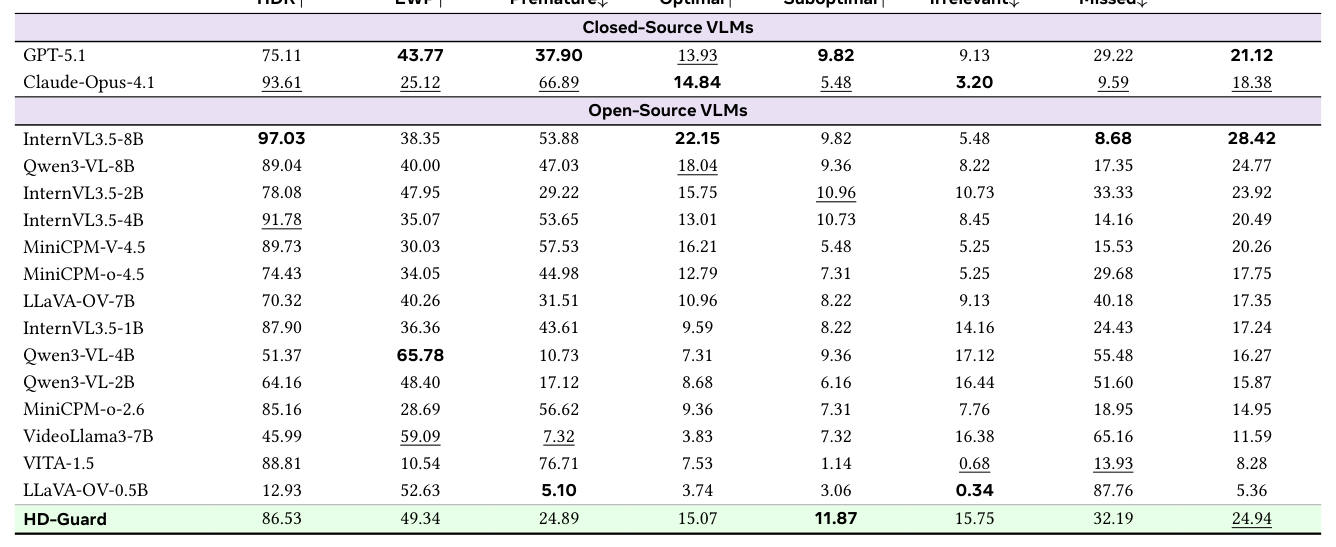

Table 1: Main results on the HomeSafe-Bench benchmark. Best and second-best scores are highlighted in bold and underlined respectively.

Table 1: Main results on the HomeSafe-Bench benchmark. Best and second-best scores are highlighted in bold and underlined respectively.

위 Table 1에 따르면, HD-Guard는 standalone FastBrain (MiniCPM-0-4.5) 대비 WSS 를 38% (18.04에서 24.94) 향상시키면서도 거의 동일한 Latency 를 유지했습니다. 또한, Qwen3-Omni 와 비교 시, HD-Guard 는 더 높은 WSS (24.94 vs. 19.35) 를 달성하고 2배 더 빠르게 (3.10s vs. 6.25s) 작동했습니다. [Figure 5] 는 HD-Guard 가 낮은 Latency 와 높은 안전 점수 사이에서 우월한 균형을 이룬다는 것을 보여줍니다. Fine-grained error analysis 결과 ( [Figure 6] 및 [Figure 9] ), HD-Guard 는 D3 시나리오에서 0% 의 Reasoning Deficit Rate 를 달성했으며, D1/D2 시나리오에서 Visual Entity Omission 을 30.4%에서 0.5% 로 크게 줄였습니다. 또한, FastBrain 의 최적 Sampling Rate 는 5 FPS 로, WSS 25.00 을 기록하며 Latency 와 Performance 간의 최적의 균형을 제공합니다 ( [Figure 7] ).

4. Conclusion & Impact

이 연구는 가정 환경에서 Embodied Agents 의 unsafe action detection을 평가하기 위한 challenging benchmark인 HomeSafe-Bench 를 소개하고, 실시간 안전 모니터링을 위한 효율적인 Hierarchical Dual-Brain Guard (HD-Guard) 아키텍처를 제안합니다. HD-Guard 는 FastBrain 과 SlowBrain 의 비동기적 협력을 통해 Latency 와 Performance 간의 최적의 Trade-off 를 달성하며, 기존 VLM 의 시각적 누락, temporal grounding 부족, 인과적 추론의 어려움과 같은 critical bottlenecks를 효과적으로 완화합니다. 이 연구는 VLM 기반 안전 탐지에 대한 새로운 평가 표준을 제시하고, 복잡한 가정 환경에서 robust하고 real-time으로 작동하는 안전한 Embodied Agents 배치를 위한 중요한 단계를 제공하여 향후 연구 방향을 제시합니다.

⚠️ 알림: 이 리뷰는 AI로 작성되었습니다.

관련 포스트

- [논문리뷰] TerraScope: Pixel-Grounded Visual Reasoning for Earth Observation

- [논문리뷰] Can Vision-Language Models Solve the Shell Game?

- [논문리뷰] Holi-Spatial: Evolving Video Streams into Holistic 3D Spatial Intelligence

- [논문리뷰] AI Gamestore: Scalable, Open-Ended Evaluation of Machine General Intelligence with Human Games

- [논문리뷰] SARAH: Spatially Aware Real-time Agentic Humans

Review 의 다른글

- 이전글 [논문리뷰] From Sparse to Dense: Multi-View GRPO for Flow Models via Augmented Condition Space

- 현재글 : [논문리뷰] HomeSafe-Bench: Evaluating Vision-Language Models on Unsafe Action Detection for Embodied Agents in Household Scenarios

- 다음글 [논문리뷰] HybridStitch: Pixel and Timestep Level Model Stitching for Diffusion Acceleration

댓글