[논문리뷰] Diffutron: A Masked Diffusion Language Model for Turkish Language

링크: 논문 PDF로 바로 열기

There may be more content that was not displayed. 저자: Şuayp Talha Kocabay, Talha Rüzgar Akkuş et al.

1. Key Terms & Definitions (핵심 용어 및 정의)

- Masked Diffusion Language Models (MDLMs) : 기존 Large Language Models (LLMs)의 autoregressive 방식과 달리, 텍스트를 반복적으로 개선하고 전체 문맥을 동시에 고려하여 생성하는 non-autoregressive 모델.

- Non-Autoregressive : 텍스트를 한 번에 한 토큰씩 순차적으로 생성하는 autoregressive 모델의 한계를 극복하기 위해 모든 토큰을 병렬로 생성하여 Inference 속도를 향상시키는 방식.

- LoRA (Low-Rank Adaptation) : Pre-trained Language Model의 Core Linguistic Knowledge를 보존하면서 특정 언어나 Task에 효율적으로 Adaptation하기 위한 Parameter-efficient Fine-tuning (PEFT) 기법.

- Instruction Tuning : Human Intent에 맞춰 Language Model의 응답을 조정하는 Fine-tuning 전략으로, Model의 Generative Capabilities를 Unlock하고 Coherence 및 Helpfulness를 향상시키는 데 활용된다.

- Agglutinative languages : 터키어처럼 단어들이 접미사를 연속적으로 붙여 다양한 문법적 관계나 의미를 표현하는 언어 유형으로, 형태론적으로 복잡한 특징을 가진다.

2. Motivation & Problem Statement (연구 배경 및 문제 정의)

Autoregressive (AR) Transformers는 현재 Large Language Models (LLMs) 분야에서 지배적이지만, 텍스트를 토큰별로 순차적으로 생성하는 본질적인 특성으로 인해 Generation Speed와 고려할 수 있는 Context에 한계가 있다. Masked Diffusion Language Models (MDLMs)가 compelling non-autoregressive 대안으로 부상했음에도 불구하고, 관련 연구는 주로 영어에 집중되어 Morphologically Rich하고 Agglutinative languages인 터키어에 대한 적용 효과는 잘 알려져 있지 않다. 이러한 새로운 Architecture를 터키어와 같은 언어에 적용하는 것은 Training Stability 및 Specific Data Requirements 측면에서 고유한 Challenge를 야기한다. 본 연구는 이러한 Critical Gap을 해소하기 위해 터키어에 특화된 Lightweight하고 Parameter-efficient한 Masked Diffusion Language Model인 Diffutron 을 제안한다.

3. Method & Key Results (제안 방법론 및 핵심 결과)

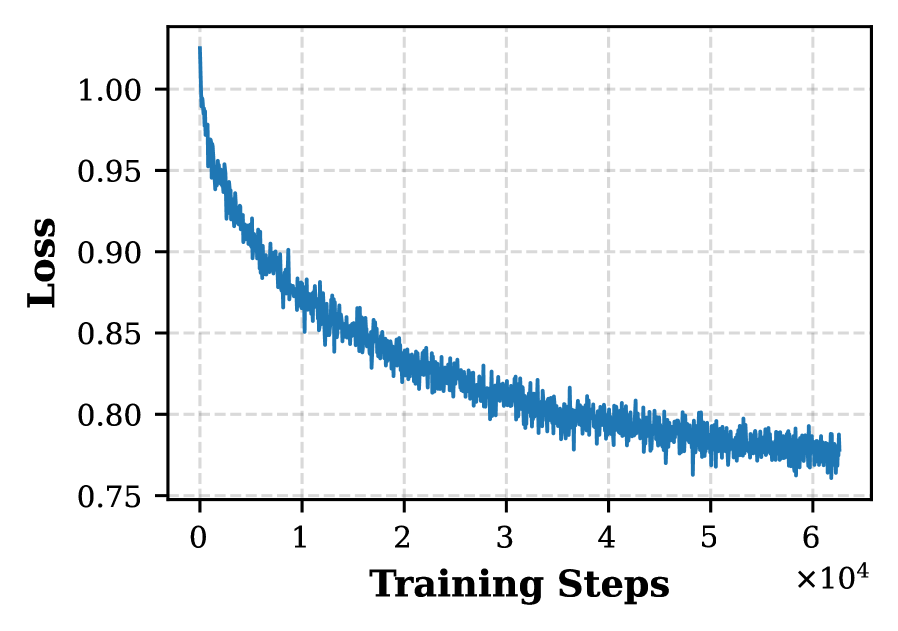

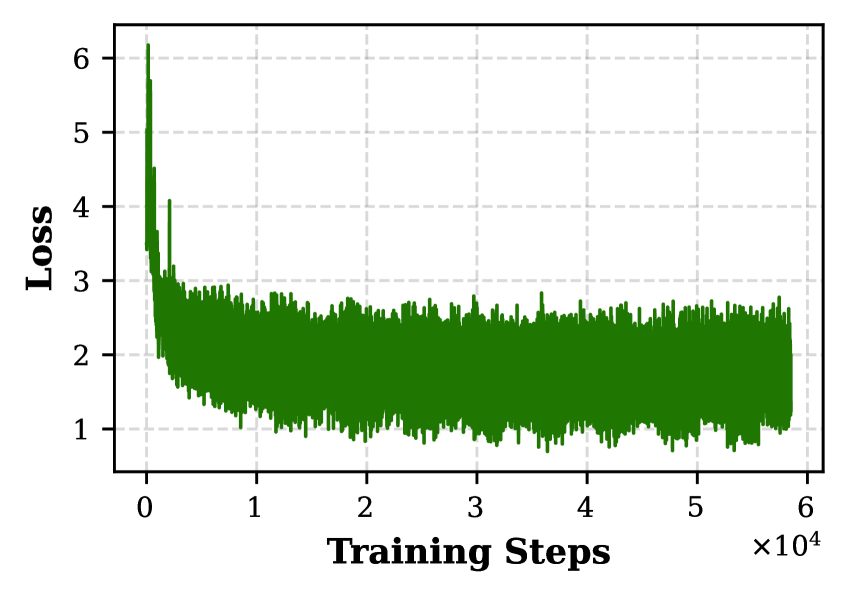

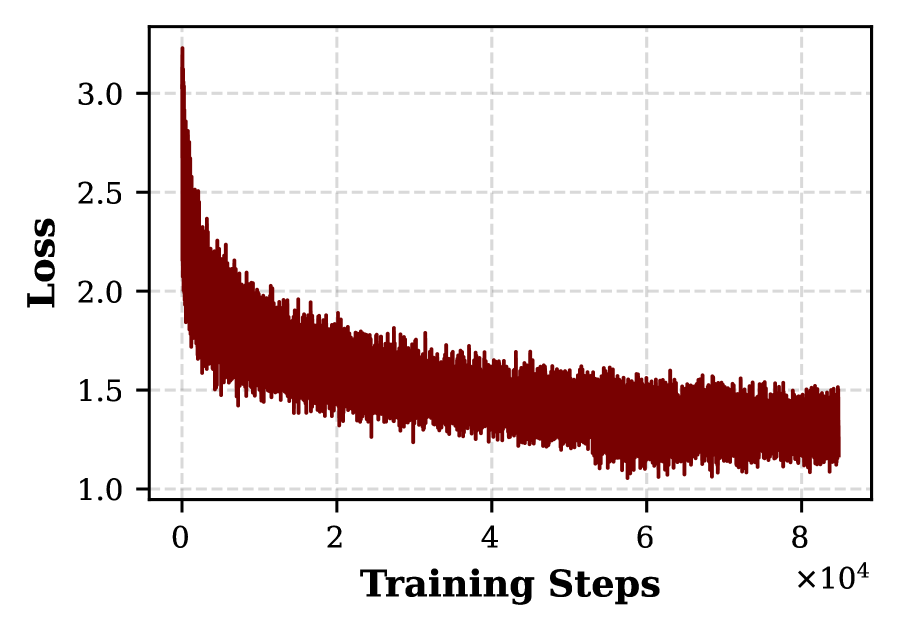

저자들은 Diffutron 을 개발하기 위해 jhu-clsp/mmBERT-base 다국어 Encoder를 기반으로 LoRA 를 활용한 Continual Pre-training (CPT)과 Progressive Instruction-tuning 전략을 포함하는 Multi-stage Training Pipeline을 제안한다. CPT 단계에서는 Havadis, Temiz-OSCAR, Turkish Wikipedia에서 Compilation한 약 200만 개의 Sequence로 구성된 Composite Dataset을 사용하여 Model을 Turkish Linguistic Dynamics에 맞춰 Alignment했다. 이 과정에서 LoRA 는 r=256 , α=256 설정으로 모든 Linear Module에 적용되어, 전체 Parameter의 약 14.94% 만 학습시키면서도 터키어의 형태론적 뉘앙스를 효과적으로 모델링했다 [Table 1]. Instruction Fine-tuning은 metunlp/LlamaTurk-Instruction-Set 을 활용한 1단계 (일반적인 Instruction-following)와 turkish-nlp-suite/InstrucTurca 를 활용한 2단계 (Task-specific Instruction)로 구성되어, Model의 Generative Capabilities를 점진적으로 강화했다. Masked Diffusion의 Reverse Process 는 Fully Masked Sequence에서 시작하여 Iteratively Masked Token을 Denoising함으로써 Entire Sentence를 Global하게 Refine한다 [Figure 1].

실험 결과, CPT 단계를 거친 DiffutronLM-0.3B-Base 는 Bilkent Turkish Writings Dataset에서 jhu-clsp/mmBERT-base 대비 Perplexity를 3.42 에서 2.75 로 크게 감소시켰으며, 이는 Model의 Predictive Capabilities 향상과 Target Language Distribution에 대한 더 나은 Alignment를 의미한다. 선정된 CETVEL 벤치마크 (Belebele_TR, EXAMS_TR, IronyTR, News Category Classification, MNLI_TR, STS_TR, XCOPA_TR)에 대한 Downstream Task Performance 평가에서는 Diffutron (2nd Stage) 가 307 million parameters 의 Compact Size에도 불구하고 평균 점수 34.68 을 달성하여, Kumru-2B (34.09) 및 TURNA (33.19) 와 같은 훨씬 큰 Baseline 모델들을 능가하는 경쟁력 있는 성능을 보여주었다 [Table 4]. 이는 Masked Diffusion Objective 가 Linguistic Knowledge를 Compact Latent Space에 Highly Effective하게 압축하며, Multi-stage Tuning Strategy가 Consistently Improvements를 가져옴을 입증한다. 특히, Diffutron 은 약 2B parameters 의 Autoregressive Baselines 대비 약 7배 더 Resource-efficient하다.

4. Conclusion & Impact (결론 및 시사점)

본 연구는 Masked Diffusion Language Models (MDLMs)를 터키어와 같은 Morphologically Rich Languages에 성공적으로 Adaptation한 Diffutron 을 제시함으로써, 이 분야에서 중요한 진전을 이루었다. 저자들은 전통적인 Autoregressive Framework에서 벗어나, Non-autoregressive Paradigm이 뛰어난 Parameter Efficiency와 Robust Linguistic Capabilities를 제공할 수 있음을 입증하였다. 이러한 연구 결과는 Massive Scale만이 Complex Languages에서 Competence를 달성하는 유일한 경로라는 기존의 인식에 도전하며, Diffusion-based Architectures가 실행 가능한 대안이 될 수 있음을 강조한다. Diffutron 이 Low-resource 및 Agglutinative Language Processing을 위한 다양한 Architectural Approaches에 대한 커뮤니티의 추가 탐구를 촉진하는 Catalyst가 되기를 기대한다.

⚠️ 알림: 이 리뷰는 AI로 작성되었습니다.

관련 포스트

- [논문리뷰] Warp-as-History: Generalizable Camera-Controlled Video Generation from One Training Video

- [논문리뷰] PanoWorld: Towards Spatial Supersensing in 360^circ Panorama World

- [논문리뷰] MatryoshkaLoRA: Learning Accurate Hierarchical Low-Rank Representations for LLM Fine-Tuning

- [논문리뷰] The TTS-STT Flywheel: Synthetic Entity-Dense Audio Closes the Indic ASR Gap Where Commercial and Open-Source Systems Fail

- [논문리뷰] OceanPile: A Large-Scale Multimodal Ocean Corpus for Foundation Models

Review 의 다른글

- 이전글 [논문리뷰] Voxtral TTS

- 현재글 : [논문리뷰] Diffutron: A Masked Diffusion Language Model for Turkish Language

- 다음글 [논문리뷰] LongTail Driving Scenarios with Reasoning Traces: The KITScenes LongTail Dataset

댓글